文献来源:Wang Y, Xing S, Can C, et al. Generative ai for autonomous driving: Frontiers and opportunities[J]. arXiv preprint arXiv:2505.08854, 2025.

专栏导读:理论落地为应用,架构转化为能力。本篇将深入自动驾驶各核心模态的生成式AI实践,系统解析图像、激光雷达、轨迹、占用栅格、视频等关键数据类型的生成技术,以及3D场景重建与编辑的前沿方法。我们还将探讨大语言模型(LLM)与多模态大语言模型(MLLM)如何重塑自动驾驶的感知-决策范式。无论您关注数据合成、仿真测试还是端到端自动驾驶,本章都将提供详尽的技术路线图与模型选型指南。

1. 图像生成:从像素控制到场景分解的自动驾驶视觉合成

图像生成是生成式AI的重要分支,也是自动驾驶数据增强与仿真测试的核心技术。不同于通用图像生成,自动驾驶场景合成具有独特挑战:首先,安全评估要求生成的图像不仅具有照片级真实感,还需满足物理合理性;其次,驾驶场景涉及异构参与者(车辆、行人、骑行者)和层次化复杂结构(静态背景与动态主体);第三,真实驾驶场景呈现长尾分布,安全关键场景属于稀有少数类。

基于这些挑战,现有方法通过特定修改或扩展通用图像生成方法,形成了三个主要技术层次:可控生成 (利用上下文信息指导生成过程)、分解式生成 (解耦静态与动态元素)以及多视角一致性生成。

1.1 可控生成:条件驱动的场景合成

可控生成利用各种域输入(如布局、文本)实现条件化与上下文感知的生成,允许以可控制方式修改上下文元素。关键条件包括:

布局信息(BEV与语义图):

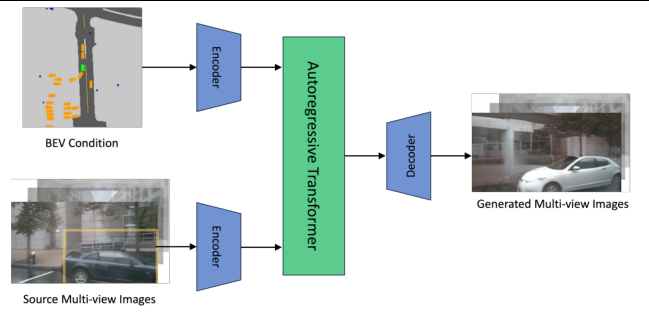

- BEVGen:利用鸟瞰图(BEV)布局,通过新颖的自回归框架结合跨视图空间注意力生成真实街景图像。模型采用双自编码器架构:一个编码BEV布局为离散潜在表示,另一个处理多视角图像token,通过相机内参引导的位置嵌入实现跨视图对齐。

- BEVControl:改进BEVGen,引入基于草图的输入,实现前景与背景元素的灵活精确编辑。采用两阶段方法:控制器(Controller)确保几何一致性,协调器(Coordinator)实现外观对齐。

- MagicDrive / MagicDrive3D:利用BEV信息(包括道路地图和物体边界框)进行多视角图像生成,结合相机姿态控制实现360°环视合成。

文本条件:

- DatasetDM:利用文本编码器融入场景描述,支持开放词汇的驾驶场景生成。

- ChatSim:采用大语言模型(LLM)智能体驱动生成过程,通过自然语言指令编辑场景。

- WeatherDG:利用大语言模型基于天气提示生成详细描述,利用其领域知识丰富基于天气的提示细节,引导扩散模型生成目标场景。

其他控制信号:

- Streetscapes:依赖卫星图像指导街景生成,实现地理一致的城市场景构建。

- SimGen:利用道路网络架构生成对应街景,支持大规模路网数据驱动的场景合成。

1.2 分解式生成:层次化场景构建

与单次生成整个场景的单一方法不同,分解式生成以结构化、分步骤方式合成环境。例如先生成道路,再在其上填充车辆。

神经场景图与模块化表示:

- Panoptic Neural Fields:引入语义感知、物体级别的场景表示,将场景分解为不同区域(如道路、建筑、车辆)。这种分割不仅产生更可解释的模型,还便于针对性编辑(如有选择地修改特定物体)。

- Block-NeRF:通过将场景划分为空间连贯的块,将神经视图合成扩展到大规模场景,支持复杂城市景观的增量式与组合式构建。

- NeuralField-LDM:采用分层潜在扩散过程,将场景生成流程分解为粗粒度与细粒度阶段。

- Urban Radiance Fields:将城市级结构嵌入神经表示,以组合方式捕获全局布局与局部细节。

仿真与传感器建模:

- UniSim / CADSim:利用神经场重建并操作大规模城市场景。通过解耦各种场景组件(如几何、外观、语义),这些仿真器可独立更新特定元素(如改变车辆位置、调整环境因素),而无需重新生成整个环境。这种模块化设计提升了可扩展性、可重用性与实时适应性。

1.3 图像生成方法对比

| 方法 | 会议/年份 | 数据集 | 建模类型 | 骨干网络 | 控制变量 | 代码 |

|---|---|---|---|---|---|---|

| BEVGen | IEEE RA-L'24 | nuScenes, Argoverse 2 | VQ-VAE | Transformer | BEV地图、物体框、文本 | GitHub |

| BEVControl | arXiv'23 | nuScenes | VAE | CNN, Transformer, CLIP | BEV草图、文本 | N/A |

| MagicDrive | ICLR'24 | nuScenes | Diffusion, VAE | U-Net | 道路地图、物体框、相机姿态 | GitHub |

| MagicDrive3D | arXiv'24 | nuScenes | 3DGS, Diffusion, VAE | U-Net | BEV地图、物体框、相机姿态 | GitHub |

| Drive-WM | CVPR'24 | Driving Data | Diffusion, VAE | U-Net | 地图、文本 | GitHub |

| SimGen | NeurIPS'24 | YouTube | Diffusion, SDEdit | U-Net | BEV、文本 | GitHub |

| DatasetDM | NeurIPS'23 | 预训练模型 | Diffusion, LLM, VAE | U-Net, ControlNet | 文本 | GitHub |

| DriveGAN | CVPR'21 | RWD | GAN, VAE | CNN, LSTM, MLP | 转向、速度、场景特征 | GitHub |

| LightDiff | CVPR'24 | nuScenes | VAE, Diffusion | U-Net | 光照条件 | GitHub |

| Streetscapes | SIGGRAPH'24 | Google Street View | Diffusion | ControlNet | 道路地图、高度图、相机姿态 | N/A |

| Wovogen | ECCV'24 | Urban Driving | Diffusion, AutoEncoder | CNN, CLIP | 文本、世界体、自车动作 | GitHub |

| HoloDrive | arXiv'24 | nuScenes | VAE, Diffusion | U-Net, Attention | 文本、2D布局 | N/A |

| WeatherDG | arXiv'24 | Cityscapes | Diffusion, LLM | VAE, U-Net | 文本 | GitHub |

| UrbanArchitect | arXiv'24 | nuScenes | Diffusion, ControlNet | VAE | 文本、3D布局 | GitHub |

| ChatSim | CVPR'24 | Waymo Open Dataset | LLM, NeRF | MLP, Transformer | 3D资产 | GitHub |

| UrbanGIRAFFE | ICCV'23 | KITTI-360, CLEVR-W | NeRF | MLP | 相机姿态、全景先验 | GitHub |

| Sat2Scene | CVPR'24 | HoliCity, OmniCity | NeRF | MLP | 卫星图像、布局、3D约束 | GitHub |

| Block-NeRF | CVPR'22 | Block-NeRF Dataset | NeRF | MLP | 空间块布局、3D约束 | GitHub |

| S-NeRF | CVPR'23 | nuScenes, Waymo Open Dataset | NeRF | MLP | 相机路径、3D约束 | GitHub |

| NF-LDM | CVPR'23 | VizDoom, Replica, AVD | Diffusion, NeRF | MLP | 场景嵌入、3D约束 | N/A |

| Panoptic NeRF | IEEE 3DIMPVT'22 | KITTI 360 | NeRF | MLP | 语义分割、3D约束 | GitHub |

| Neural Point Light Field | CVPR'22 | Waymo Open Dataset | NeRF | MLP | 相机姿态、3D约束 | GitHub |

| Neural Scene Graphs | CVPR'21 | KITTI | NeRF | MLP | 物体图拓扑、3D约束 | GitHub |

| UniSim | CVPR'23 | PandaSet | NeRF | MLP | 智能体配置文件、3D约束 | N/A |

| CADSim | CoRL'23 | MVMC, PandaSet | 可微CAD渲染 | MLP | CAD几何、3D约束 | N/A |

2. 激光雷达生成:点云世界的神经合成

激光雷达点云生成是生成式AI在自动驾驶中的关键应用,直接支撑感知、仿真和系统验证。高保真激光雷达数据对训练鲁棒感知模型、测试规划算法和仿真多样化驾驶场景至关重要。与摄像头等其他模态不同,激光雷达提供精确的3D空间信息,是L4/L5级自动驾驶中目标检测、语义分割和轨迹预测等任务不可或缺的数据源。

2.1 技术挑战

激光雷达生成面临独特挑战:

- 数据稀缺性:真实世界激光雷达场景的多样性有限,现有数据集在天气、交通密度和道路几何等方面的变化不足。

- 物理特性建模:准确模拟激光雷达特有特性(包括稀疏非均匀点云、射线丢失效应、与反射表面的交互)具有独特难度。

- 几何与语义一致性:生成数据需在不同场景下保持几何和语义一致性,同时满足大规模仿真和测试的计算效率要求。

- 评估基准缺失:缺乏评估生成激光雷达数据保真度和实用性的标准基准,增加了开发和采纳的复杂性。

2.2 技术演进路线

早期物理仿真方法 :

早期方法主要依赖基于物理的仿真,使用光线投射和手工制作的传感器模型近似真实激光雷达特性。例如:

- LiDARsim:整合U-Net模型模拟射线丢失效应,融合基于物理的渲染与真实世界数据。

- PCGen:采用第一峰值平均(FPA)光线投射,结合基于MLP的替代模型细化射线丢失仿真。

扩散模型方法(当前主流):

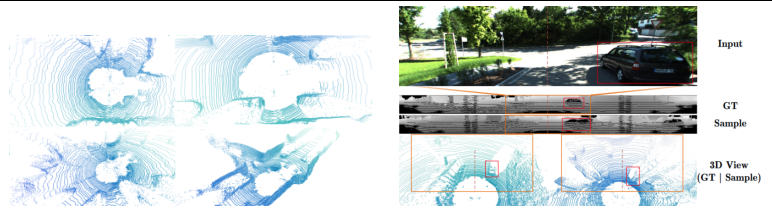

- LiDMs:提出用于激光雷达场景生成的潜在扩散框架,采用曲线级压缩、点级坐标监督和块级编码,保留结构和几何细节。

- RangeLDM:引入结合霍夫变换精确范围视图投影、基于VAE的潜在空间压缩和范围引导判别器的潜在扩散框架,实现高保真点云合成。

- LidarDM:将扩散扩展到4D激光雷达合成,首先生成3D场景和动态参与者,然后仿真时序连贯的传感器观测。

- DynamicCity:采用基于Diffusion Transformer(DiT)和VAE的HexPlane编码,通过投影模块和姿态展开策略优化大规模激光雷达场景合成。

- Text2LiDAR:引入文本引导的激光雷达合成,利用基于Transformer的等距圆柱投影注意力机制与控制信号嵌入注入器(CEI)和频率调制器(FM),基于文本描述生成细粒度多样化点云。

NeRF-based方法:

- NeRF-LiDAR:基于NeRF的框架,从多视角图像和稀疏激光雷达合成具有语义标签的真实激光雷达点云,使用点和特征级对齐增强结构一致性。

- LiDAR4D:引入可微分的仅激光雷达框架,用于新颖时空视图合成,采用4D混合表示和几何约束实现几何感知和时序一致的动态重建。

- DyNFL:引入组合神经场框架,通过分别重建静态背景和动态物体,实现动态激光雷达场景的高保真重新仿真,支持灵活的场景编辑和改进的物理真实感。

VQ-VAE-based方法:

- UltraLiDAR:采用VQ-VAE将稀疏激光雷达点云编码为紧凑离散token,使用Transformer建模以实现稀疏到稠密补全和可控场景生成。

- LidarGRIT:结合自回归Transformer与VQ-VAE在潜在空间中进行渐进式范围图像合成,显式建模射线丢失噪声掩码以改进几何保真度。

2.3 激光雷达生成方法对比

| 方法 | 会议/年份 | 数据集 | 建模类型 | 骨干网络 | 控制机制 | 生成类型 | 代码 |

|---|---|---|---|---|---|---|---|

| LiDMs | CVPR'24 | nuScenes, KITTI-360 | Diffusion | CNN, U-Net | 多模态条件 | 场景生成 | GitHub |

| RangeLDM | ECCV'24 | KITTI-360, nuScenes | Diffusion, VAE | CNN, U-Net | 部分点云 | 场景补全、生成 | GitHub |

| LidarDM | ICRA'25 | KITTI-360, WOD | Diffusion, VAE | CNN | 语义地图 | 激光雷达仿真与光线投射 | GitHub |

| DynamicCity | ICLR'25 | Occ3D, CarlaSC | Diffusion, VAE | Transformer, CNN | 布局、轨迹、文本、修复 | 4D占用场景生成 | GitHub |

| GenMM | arXiv'24 | BDD100K, WOD | Diffusion | U-Net, Transformer | 3D边界框、参考图像 | 物体级操作 | N/A |

| Text2LiDAR | ECCV'24 | KITTI-360, nuScenes | Diffusion | Transformer | 文本 | 全场景生成 | GitHub |

| UltraLiDAR | CVPR'23 | PandaSet, KITTI | VQ-VAE | Transformer | 稀疏点云 | 场景补全、生成 | N/A |

| LidarGRIT | CVPR-W'24 | KITTI-360, KITTI odometry | VQ-VAE | Transformer | 无条件 | 场景生成 | GitHub |

| NeRF-LiDAR | CVPR'24 | nuScenes | NeRF | U-Net, MLP | 相机姿态、多视角图像 | 激光雷达仿真 | GitHub |

| LiDAR4D | CVPR'24 | KITTI, nuScenes | NeRF | U-Net, MLP | 相机姿态、多视角激光雷达点云 | 激光雷达仿真 | GitHub |

| DyNFL | CVPR'24 | WOD | Neural SDF | MLP | 激光雷达扫描、3D边界框 | 激光雷达仿真 | GitHub |

| LiDARsim | CVPR'20 | LiDARsim Dataset | 基于物理的光线投射 | 光线投射引擎, U-Net | 3D背景、动态物体网格 | 激光雷达仿真 | N/A |

| PCGen | ICRA'23 | WOD | FPA光线投射 | 光线投射引擎, MLP | 重建场景 | 激光雷达仿真 | N/A |

| LiDARGEN | ECCV'22 | KITTI-360, nuScenes | 基于分数的 | U-Net | 稀疏点云 | 场景生成 | GitHub |

3. 轨迹生成:从单智能体规划到多智能体交互预测

轨迹生成(合成车辆、行人或其他参与者的运动序列)是自动驾驶的核心任务,应用范围涵盖自动驾驶汽车到移动机器人导航。随着自主系统进入复杂动态环境,传统基于优化的运动合成和概率图模型方法在处理不确定性、多智能体交互和实时适应性方面面临局限。这推动了向生成式AI的范式转变,利用生成式深度学习建模多模态、上下文感知的轨迹,同时平衡安全性、效率以及物理或社会约束的合规性。

3.1 传统方法向生成式范式转变

传统运动规划通常基于安全和舒适性标准寻求单一最优轨迹,在高不确定性或复杂交互下往往不足。生成式模型提供了范式转变,将轨迹生成重构为从学习到的合理未来分布中采样。这种方法自然处理不确定性和多模态性,对外部参与者行为预测和自车路径规划至关重要,也用于生成真实的大规模交通仿真。

3.2 基于VAE与GAN的方法

VAE方法 :

VAE擅长通过基于输入上下文(如过去轨迹、地图、智能体交互)学习潜在分布来捕获不确定性和生成多样化可能性。在单智能体预测或规划中,允许基于感知意图或环境因素采样多个潜在未来。

- DESIRE:生成多样化、社会合理的多智能体轨迹,采用排序机制提高一致性。

- Trajectron / Trajectron++:引入动态图结构显式建模交互,显著影响该领域。Trajectron++进一步通过整合地图信息和车辆动力学约束增强真实感。

- STGDAT:提出通用生成神经系统,涉及异构多智能体轨迹预测,通过关系归纳偏置显式建模交互。

GAN方法 :

通过对抗训练过程生成高度真实轨迹,生成器试图欺骗训练用于区分真实数据与生成样本的判别器。

- CGNS:引入条件生成神经系统生成车辆的多模态未来轨迹。

- PathGAN:直接从视觉输入和高级意图生成真实自车路径。

- Social GAN:引入池化机制聚合社交上下文。

- SoPhie / Social-BiGAT:采用注意力机制和图表示更好地捕获交互,生成符合社会规范的多智能体预测。

特性对比 :

VAE提供固有的多样性和概率解释,适合探索潜在未来和表示不确定性;GAN通常实现更高感知真实感,但可能遭受模式坍缩和训练不稳定。

3.3 扩散模型:当前主流技术

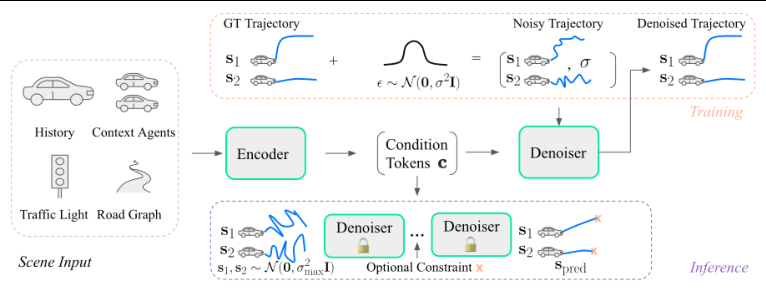

扩散模型已成为轨迹任务的强大生成模型类别,提供高样本质量和稳定训练。通过学习逆转逐步向数据添加噪声的扩散过程,有效学习将随机噪声"去噪"为结构化轨迹。

多智能体与交互建模:

- MotionDiffuser:在扩散框架内采用置换不变Transformer,为多个智能体生成可控、避碰的联合轨迹。

- SDT:进一步扩展这种组合规模。

- Diffusion-Planner:在单一扩散框架内整合多智能体预测和自车规划,实现交互感知驾驶,无需手动定义规则。

交通仿真 :

扩散模型支持灵活、长时程、可控的场景生成:

- DJINN / Scenario Diffusion / SceneDiffuser:联合建模智能体交互,允许用户定义约束。

- Scenario Dreamer:使用潜在扩散扩展生成规模。

优势与挑战 :

扩散模型在捕获复杂数据分布方面表现卓越,能够生成真实且多样化的轨迹。但迭代采样过程计算成本高昂,对实时部署构成挑战,尽管加速技术正在快速发展。

3.4 序列模型与语言模型方法

利用自然语言处理中序列建模的成功,Transformer和MLLM越来越多地应用于轨迹生成,将轨迹视为状态或token序列。

直接序列生成:

- BehaviorGPT:使用自回归下一patch预测,实现轻量级、高保真交通仿真。

- TrafficGen:采用可解释的自回归编码器-解码器结构,从日志数据顺序生成真实交通场景。

多模态大语言模型(MLLM) :

MLLM提供将更广泛世界知识、推理能力和多模态输入(文本、图像、激光雷达)纳入轨迹生成过程的潜力。

- GPT-Driver:使用GPT-3.5基于文本场景描述生成轨迹token。

- DriveLM:结合结构化视觉表示与LLM推理。

- LMDrive:采用闭环方法将传感器数据映射到控制。

- EMMA / OpenEMMA:直接使用思维链推理将原始传感器数据映射到驾驶动作。

挑战 :

将基于语言的输出锚定到物理现实、确保安全性和鲁棒性、管理巨大数据需求以及计算成本是主要挑战。在复杂交互式多智能体预测和仿真中的应用相对扩散模型或CVAE仍较初级。

3.5 轨迹生成方法对比

| 方法 | 会议/年份 | 数据集 | 建模类型 | 骨干网络 | 代码 |

|---|---|---|---|---|---|

| Kim et al. | IEEE Access'21 | Real-world Driving | CVAE | DeepConvLSTM | N/A |

| Barbié et al. | JRM'19 | Synthetic | CVAE | RNN | N/A |

| CGNS | IROS'19 | ETH/UCY, SDD | GAN | CNN | N/A |

| EvolveGraph | NeurIPS'20 | ETH/UCY, SDD, H3D | Autoregressive | GNN | N/A |

| STG-DAT | T-ITS'21 | ETH/UCY, SDD | CVAE | GNN | N/A |

| PathGAN | ETRI'21 | iSUN | GAN | CNN | GitHub |

| MID | CVPR'22 | ETH/UCY, Stanford Drone | Diffusion | Transformer | GitHub |

| LED | CVPR'23 | ETH/UCY | Diffusion | Leapfrog | GitHub |

| SingularTrajectory | CVPR'24 | Multiple Benchmarks | Diffusion | SVD | GitHub |

| Diffusion-Planner | ICLR'25 | nuPlan | Diffusion | Transformer | GitHub |

| GPT-Driver | NeurIPS'23 | nuScenes | LLM | Transformer | GitHub |

| DriveLM | ECCV'24 | nuScenes | VLM | Transformer | GitHub |

| LMDrive | CVPR'24 | CARLA | LLM | Transformer | GitHub |

| OpenEMMA | WACV'25 | nuScenes | VLM | Transformer | GitHub |

| Desire | CVPR'17 | KITTI, Stanford Drone | CVAE | RNN | GitHub |

| Trajectron | ICCV'19 | ETH/UCY | CVAE | Graph RNN | GitHub |

| Trajectron++ | ECCV'20 | ETH/UCY, nuScenes | CVAE | Constrained Graph RNN | GitHub |

| Social GAN | CVPR'18 | ETH/UCY | GAN | RNN | GitHub |

| SoPhie | CVPR'19 | ETH/UCY | GAN | Cross Attention | GitHub |

| Social-BiGAT | NeurIPS'19 | ETH/UCY | Bicycle-GAN | Graph Attention Network | N/A |

| MotionDiffuser | CVPR'23 | WOMD | Diffusion | Transformer | N/A |

| SDT | OpenReview'24 | AV2 | Diffusion | Transformer | N/A |

| Westny et al. | arXiv'24 | rounD, highD | Diffusion | GNN | N/A |

| LMTrajectory | CVPR'24 | ETH/UCY | LLM | Transformer | GitHub |

| TrafficSim | CVPR'21 | ATG4D2 | CVAE | GNN | N/A |

| TrafficBots | ICRA'23 | WOMD | CVAE | MLP | GitHub |

| DJINN | NeurIPS'23 | INTERACTION | Diffusion | Transformer | N/A |

| Scenario Diffusion | NeurIPS'23 | AV2 | Diffusion | UNet | N/A |

| BehaviorGPT | NeurIPS'25 | WOMD | Autoregressive | Transformer | N/A |

4. 占用栅格生成:从二维分割到四维时空预测

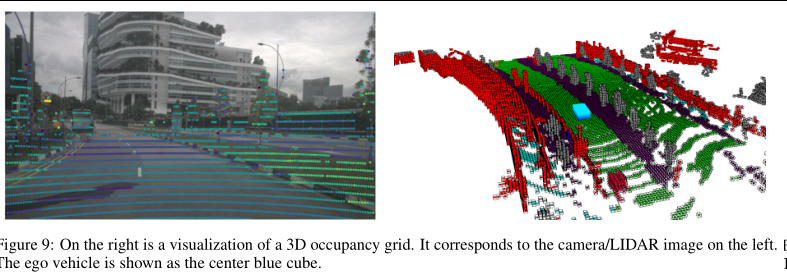

与其他模态(图像或激光雷达)不同,3D占用栅格生成面临独特挑战:不存在可用于训练或质量评估的真值占用栅格。流行数据集如nuScenes和Waymo不包含3D占用模态。因此,该领域研究者通常需要开发自己的方法,利用特定时间步的相机和/或激光雷达输入计算场景在该时间步的3D占用栅格。

4.1 占用栅格真值构建方法

Occ3D:引入使用激光雷达和相机数据的高分辨率占用基准,能够捕获预定义本体之外物体的详细多样化城市场景占用。

TPVFormer:从传统鸟瞰图(BEV)出发,通过添加侧视图和前视图增强3D空间表示。使用三视角视图(TPV)和基于Transformer的交叉注意力,结合稀疏激光雷达数据与相机输入,即使在有限3D数据下也能实现竞争性性能。

SurroundOcc:通过融合多帧激光雷达扫描与高分辨率相机图像解决占用稀疏性问题;应用空间注意力和3D卷积从低到高分辨率渐进上采样,通过泊松重建填充遮挡区域,保持场景一致性和深度精度。

OccGen:采用独特生成方法,将占用计算框架为"噪声到占用"的扩散过程,逐步细化占用图,提供在准确性和计算成本间平衡的灵活性,并提供不确定性估计,特别擅长处理场景中遮挡或模糊区域。

UniOcc:提供从流行驾驶数据集获取占用标签的统一基准和工具包。

4.2 占用生成:从静态场景到动态世界

UrbanDiffusion:使用基于扩散的模型生成以鸟瞰图(BEV)地图为条件的静态3D占用栅格。这些可通过MetaDrive编辑的BEV地图指导模型的语义和几何场景生成。方法采用两阶段训练:首先,VQ-VAE将真值占用栅格嵌入针对重构损失优化的潜在表示;其次,潜在嵌入与BEV特征拼接后通过3D U-Net进行去噪。虽然该方法实现结构化、语义一致的 Scene,但输出限于静态单帧。

OccSora:将生成扩展到以自车轨迹为条件的动态多帧场景。与UrbanDiffusion类似,OccSora采用两步训练方法。首先,4D占用Tokenizer将历史占用栅格压缩为离散token,通过4D解码器重构。其次,扩散Transformer通过以编码轨迹为条件对这些token进行去噪来生成未来占用。这种设计使OccSora能够仿真多帧上的时序一致场景演化。

DOME:生成以轨迹为条件的动态占用序列,采用时空扩散Transformer预测长时程未来帧。DOME首先使用VAE将历史占用压缩为针对重构损失优化的潜在嵌入。这些嵌入与历史占用和自车轨迹输入结合,指导Transformer预测未来占用。值得注意的是,DOME引入轨迹重采样方法,增强对生成场景的控制,支持细粒度、轨迹对齐的预测和高分辨率输出。

DynamicCity:采用HexPlane场景表示,通过DiT条件生成4D占用,实现高质量动态场景生成。

OccLLaMA:独特整合视觉、语言和动作模态进行占用生成。与其他方法类似,使用VQ-VAE将历史占用标记化为离散场景token。然而,OccLLaMA还将自车运动标记化为动作token,将语言描述标记化为文本token。这三种token类型由预训练的LLaMA处理,微调以预测未来场景、动作和文本token。预测token解码为占用栅格、运动规划和文本输出,实现多模态能力,如运动规划和视觉问答,除占用生成外。

4.3 占用预测:从当前到未来的推演

占用预测基于过去占用栅格生成未来帧占用栅格,以2D或3D表示。

OccWorld:利用生成模型预测3D环境和自车轨迹的演化。使用变分自编码器(VAE)将当前场景编码为离散token,然后通过时空Transformer预测未来场景token和车辆状态。这种设计允许OccWorld捕获随时间推移的细粒度环境变化,无需实例级标注或预标记物体类别。

UNO (Unsupervised Occupancy):以自监督学习方式连续预测4D占用场(跨越空间和时间)。UNO通过从激光雷达点生成伪标签构建占用图,捕获占用和自由空间。采用隐式解码器在任何时空点进行占用预测,使其适应点云预测和鸟瞰图(BEV)格式语义占用预测等任务。

4.4 占用生成方法对比

| 方法 | 会议/年份 | 数据集 | 建模类型 | 骨干网络 | 控制机制 | 生成类型 | 代码 |

|---|---|---|---|---|---|---|---|

| UrbanDiffusion | arXiv'24 | nuScenes via Occ3D | VQ-VAE | Diffusion | BEV布局 | 静态场景 | Not Released |

| DOME | arXiv'24 | nuScenes via Occ3D | VAE | DiT | 自车轨迹 | 场景与智能体 | Not Released |

| OccWorld | ECCV'24 | nuScenes via Occ3D | VQ-VAE | Transformer | 过去占用 | 场景与智能体 | GitHub |

| OccSORA | arXiv'24 | nuScenes via Occ3D | VQ-VAE | DiT | 自车轨迹、过去占用 | 场景与智能体 | GitHub |

| OccLLaMA | arXiv'24 | nuScenes via Occ3D | VQ-VAE | LLaMA | 语言 | 场景与智能体 | Not Released |

| UnO | CVPR'24 | nuScenes, Argoverse2 | Not Specified | Transformer | 过去占用 | 语义激光雷达 | Not Released |

| DynamicCity | ICLR'25 | CARLA | VAE | DiT | 自车轨迹 | 场景与智能体 | GitHub |

|

5. 视频生成:世界模型的时序一致性挑战

视频是自车视角场景的主流表示之一。尽管在视频生成领域已取得显著进展,确保长时程时序一致性仍是挑战。历史上,驾驶场景中的算法生成视频用于通过提供更多训练数据或形成提供真实感传感器输入的驾驶仿真平台来促进自动驾驶算法学习。

因此,驾驶场景中的视频生成方法应保持以下特性:

- 关于环境和物体的几何与时序一致性;

- 自车和其他车辆的运动应遵循真实交通流;

- 驾驶数据是长尾分布,因此视频生成过程应支持细粒度控制。

5.1 技术方法论视角

现有方法通常:

- 通过开发空间或时间注意力实现几何与时序一致性;

- 通过利用结构信息(包括BEV地图、HD地图、3D布局)确保合理交通流;

- 基于图像、文本、深度、相机姿态、BEV、HD地图、3D布局和驾驶动作等条件进行生成。

5.2 驾驶视频生成

Panacea:从包括图像、文本和BEV序列的多种控制信号生成全景多视角驾驶视频。利用潜在扩散模型作为生成先验,采用ControlNet结构控制视频生成。优化视频生成以拟合提供的BEV序列,确保视频遵循真实交通流。开发视图内和跨视图注意力以及跨帧注意力,确保生成视频的几何和时序一致性。但通常以2Hz生成8帧视频,对于训练自动驾驶算法相对较短且稀疏。

Delphi:通过开发包括噪声分解和重新初始化以及特征对齐时序一致性在内的技术,进一步实现40帧长视频生成。但由于依赖3D边界框标注,其时序分辨率限制为2Hz。

DriveScape:通过开发双向调制Transformer技术,在稀疏条件下确保3D结构信息的精确对齐,进一步克服此问题,实现高达10Hz的时序分辨率。

5.3 闭环自动驾驶中的视频生成

与通用视频生成任务不同,闭环仿真的视频生成需要准确建模自车与环境间的交互。许多工作展示明显的"生成-执行"范式。

DriveDreamer / GenAD / Vista:可通过两阶段训练联合建模驾驶员动作。第一阶段训练视频生成模型;第二阶段提供驾驶员动作,要求模型预测视频的未来帧。因此,这些模型可对驾驶策略做出反应。

DrivingWorld:使用GPT风格结构和端到端单阶段训练,联合建模视频生成与车辆位置以预测未来帧。

Doe-1:提出具有感知-规划-预测范式的自动驾驶系统,其中视频生成以智能体为条件。

5.4 多模态大语言模型辅助视频生成

随着多模态大语言模型的发展,其强大推理能力被广泛应用于许多领域。在自动驾驶中,除用作驾驶场景中的一般问答解决方案外,许多工作专门利用MLLM进行驾驶视频生成。

DriveDreamer2:利用MLLM生成合理的BEV轨迹作为条件信号。

ChatSim:构建使用MLLM的多智能体系统,实现交互式和空间一致的视频编辑。

Doe-1:利用VQA作为感知-规划-生成流程中的场景描述生成器。

5.5 视频生成方法对比

注:条件列中,I=图像,T=文本,E=BEV,B=边界框或布局,D=深度,C=相机,M=地图,A=驾驶员动作,O=光流,J=轨迹,S=主体,H=高级指令如命令和目标点。括号内为可选条件。

| 方法 | 年份 | 建模 | 骨干网络 | 帧数 | FPS | 条件 | 闭环 | LLMs | 代码 |

|---|---|---|---|---|---|---|---|---|---|

| Panacea | CVPR'24 | Diffusion | ControlNet | 8 | 2 | ITEBDCM | - | - | GitHub |

| Delphi | CoRR'24 | Diffusion | U-Net | 40 | 2 | TEBC | ✓ | - | N/A |

| DriveDreamer | ECCV'24 | Diffusion | U-Net, Transformer | 32 | 12 | ITMBA | ✓ | - | GitHub |

| DriveDreamer-2 | ArXiv'24 | Diffusion | U-Net | 8 | 4 | T(ECI) | ✓ | ✓ | GitHub |

| DriveScape | ArXiv'24 | Diffusion | U-Net | 30 | 2-10 | IMEB | - | - | N/A |

| DriveArena | CoRR'24 | Diffusion, AR | U-Net | N/A | 12 | TBCM | ✓ | - | GitHub |

| DriveGen | ArXiv'24 | Diffusion | U-Net | - | - | ITB | - | - | GitHub |

| DrivingDiffusion | ECCV'24 | Diffusion | U-Net | - | - | ITBO | - | - | GitHub |

| Vista | CoRR'24 | Diffusion, AR | U-Net | 25 | 10 | I(AHJ) | ✓ | - | GitHub |

| SubjectDrive | CoRR'24 | Diffusion | ControlNet | 8 | 2 | ITSB | - | - | N/A |

| GenAD | CVPR'24 | Diffusion | Transformer | 8 | 2 | ITAJ | ✓ | - | N/A |

| DrivingWorld | ArXiv'24 | AR | Transformer, GPT | 400 | 10 | IJ | ✓ | - | GitHub |

| Doe-1 | ArXiv'24 | N/A | N/A | - | 2 | ITJ | ✓ | ✓ | GitHub |

| ChatSim | CVPR'24 | Agent | N/A | 40 | 10 | IT | ✓ | ✓ | GitHub |

6. 3D/4D重建与生成:从隐式场到显式高斯的几何正确性追求

驾驶场景中的3D几何正确性至关重要。许多场景生成方法不学习图像或视频中的间接3D结构,而是引入利用点云、NeRF和3D高斯溅射(3DGS)等3D表示的直接3D结构学习。

6.1 3D表示范式

3D表示指存储和操作静态或动态几何(和外观)的隐式或显式方法。本部分聚焦于驾驶场景生成中主要使用的表示:3D点云、神经辐射场(NeRF)和3D高斯溅射(3DGS)。

虽然多视角立体(MVS)图像是驾驶场景中使用的常见表示之一,但已在视频和图像生成部分讨论,此处不再赘述。

6.2 3D驾驶场景重建

重建或表示是假设输入数据结构上固定先验的生成模型类型的基础组件。

点云重建 :

许多驾驶数据集通过融合标定激光雷达扫描提供场景点云,作为使用局部激光雷达帧或多视角图像进行街景点云重建的基准。

神经辐射场(NeRF) :

利用可学习的密度和外观场隐式表示3D场景。虽然在新视角合成中实现高性能渲染质量,但将其应用于驾驶场景面临大规模场景、低重叠视角、无界空间等挑战。

- Block-NeRF:开发拆分-合并模式重建超大规模场景。

- UrbanNeRF / DNMP:利用通常可在自动驾驶车辆上获得的额外激光雷达输入增强几何信息。

- S-NeRF:专门通过解耦背景和前景、利用激光雷达监督和为自车专门设计的相机参数化来解决低重叠问题。

- EmerNeRF / Julian et al.:分解动态和静态场景,实现动态街景的全面重建。

3D高斯溅射(3DGS) :

显式将场景表示为一组属性化的3D高斯,通过开发GPU友好型光栅化程序实现实时可微分新视角合成(NVS)。

- OmniRe:显著实现4D街景的全景重建,包括背景环境、车辆、行人和其他可变形动态物体。

- SGD:利用扩散先验和稀疏激光雷达扫描解决驾驶帧的稀疏视角问题。

- VastGaussian / CityGaussian:专门通过分而治之策略改进大规模场景重建。

基于Transformer的前馈模型 :

采用DUSt3R及其度量尺度扩展MASt3R的开创性工作,将多视角图像映射为像素对齐点图。在自动驾驶中,STORM统一驾驶数据集训练Transformer,从稀疏输入推断动态3D场景,实现高保真渲染和近实时性能。

6.3 3D驾驶场景生成

直接3D表示生成 :

这些方法旨在为驾驶场景生成动态或静态3D表示。

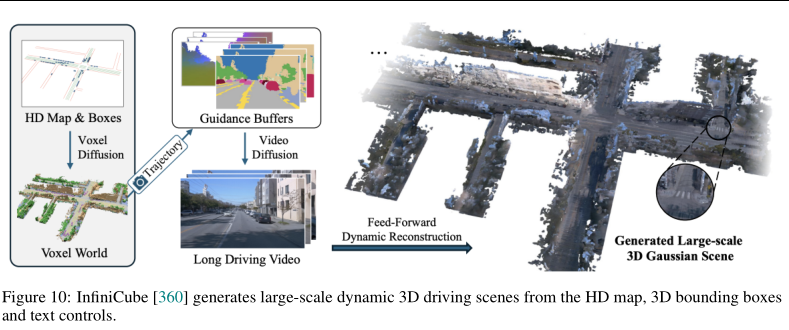

- InfiniCube:以Outpaint-and-Fuse方式实现无限尺度动态驾驶场景生成,动态驾驶场景通过微调的 Controllable 视频扩散模型和双分支3D重建模块扩展。

- MagicDrive3D:利用视频生成模型的扩散先验,并对齐帧间单目深度预测,为静态驾驶场景生成3DGS表示。

- DreamDrive:类似地依赖3DGS建模3D驾驶场景,然后应用扩散生成未来场景。

- DiST-4D:通过利用先验多视角RGB序列并在现有相机位置执行新视角合成来预测度量深度,从而优化可泛化的时空扩散。

3D作为中间表示 :

这些方法旨在借助体素、点云等3D表示生成驾驶视频或图像。与上述类别不同,这些方法不生成支持在生成场景后以任意轨迹进行新视角渲染的3D表示。

- WoVoGen:基于过去观测和驾驶动作生成未来视频。采用扩散模型作为生成先验,开发世界体表示增强几何一致性。

- Stag-1:使用投影-and-Outpaint范式生成动态3D场景的多视角驾驶视频,利用扩散模型作为生成先验,点云作为几何约束。

- ChatSim:开发多智能体系统为动态3D场景生成照片级真实视频,其中NeRF用作背景3D表示,3D资产表示前景物体。

6.4 3D/4D生成方法对比

*注:条件列中,M=地图,I=图像或视频,B=3D边界框或布局,J=轨迹,T=文本,O=不透明度,C=相机,A=驾驶动作。表示论文未呈现但后续支持的方法。†表示具有生成先验的重建模型。

| 方法 | 会议/年份 | 任务 | 建模类型 | 骨干网络 | 条件 | 输出 | 代码 |

|---|---|---|---|---|---|---|---|

| InfiniCube | ArXiv'24 | 4D生成 | 3DGS, Diffusion | 3D U-Net, ControlNet, DiT | MBJT | 视频, 3DGS | N/A |

| WoVoGen | ECCV'24 | 4D生成 | Diffusion | 3D U-Net, Transformer | MOTA | 视频 | GitHub |

| DriveX | ArXiv'24 | 4D生成 | Diffusion | U-Net | MOTA | 视频, 3DGS | GitHub |

| ChatSim | CVPR'24 | 4D生成 | NeRF, 3DGS* | Transformer | IT | 视频 | GitHub |

| MagicDrive3D | CORR'24 | 4D生成 | 3DGS | MLP | TEBJ | 视频, 3DGS | GitHub |

| DreamDrive | Arxiv'24 | 4D生成 | 3DGS, Diffusion | MLP | IJ | 视频, 3DGS | N/A |

| OmniRe | ICLR'25 | 4D重建 | 3DGS, Graph | N/A | I(CD) | 3DGS, SMPL | GitHub |

| CoDa-4DGS | ArXiv'25 | 4D重建 | 3DGS | MLP | ICD | 3DGS | N/A |

| 4DGF | NeurIPS'24 | 4D重建 | 3DGS, Graph | N/A | IC(D) | 3DGS | GitHub |

| StreetGaussian | ECCV'24 | 4D重建 | 3DGS | N/A | ICD | 3DGS | GitHub |

| DrivingGaussian | CVPR'24 | 4D重建 | 3DGS | N/A, Graph | ICD | 3DGS | N/A |

| SGD | CORR'24 | 4D重建† | 3DGS | U-Net, ControlNet | ITCD | 3DGS | N/A |

| EmerNeRF | ICLR'24 | 4D重建 | NeRF | MLP | ICD | NeRF | GitHub |

| VastGaussian | CVPR'24 | 3D重建 | 3DGS | CNN | IC | 3DGS | N/A |

| CityGaussian | ECCV'24 | 3D重建 | 3DGS | N/A | IC | 3DGS | GitHub |

| DNMP | ICCV'23 | 3D重建 | Voxel, Mesh | MLP | ICD | Voxel, Mesh | GitHub |

| S-NeRF | ICLR'23 | 3D重建 | NeRF | MLP | ICD | NeRF | GitHub |

| BlockNeRF | CVPR'22 | 3D重建 | NeRF | MLP | IC | NeRF | N/A |

| UrbanNeRF | CVPR'22 | 3D重建 | NeRF | MLP | ICD | NeRF | N/A |

| Julian et al. | CVPR'21 | 4D重建 | NeRF, Graph | MLP | IC | NeRF | GitHub |

| STORM | ICLR'25 | 4D重建 | 3DGS | Transformer | IC | 3DGS | GitHub |

7. 场景编辑:从像素操作到3D物理解耦

场景编辑是自动驾驶中新兴但相对未被充分探索的领域。两个主要任务方向是图像编辑和3D编辑。两者都旨在通过无缝添加、移除或修改场景中的物体来操作原始传感器数据。这种能力允许创建多样化、上下文准确的场景,对训练和评估自主系统至关重要。

7.1 图像编辑:域迁移与风格化

图像编辑旨在直接编辑相机图像,无需在3D中理解驾驶场景。历史上,直接图像编辑依赖配对图像数据将图像从一个域映射到另一个域(如Pix2Pix、SPADE等)。

在自动驾驶域中,虽然存在类似工作执行去雨、去雾、去雪或其他恢复任务,但它们需要配对图像数据,而这种数据不像通用视觉任务那样容易获得(例如,很难在同一场景同时收集晴天和雨天的完全相同时刻)。这需要不依赖配对数据的更数据友好方法。

One-Step Image Translation:引入基于文本条件、基于扩散的图像翻译方法。具体而言,作者在预训练的StableDiffusion模型之上应用CLIP文本调节器,实现驾驶场景上的天气、光照变化,无需配对真值数据。

7.2 3D编辑:神经场的场景操作

许多3D重建工作也适合3D编辑。本部分专注于专门旨在3D编辑的工作。3D编辑在理解场景后编辑驾驶场景。一种主导范式是采用两个顺序步骤,首先学习静态背景的表示,然后学习移动物体的表示。

代表性方法:

- UniSim:采用基于NeRF的骨干网络,使用多分辨率体素网格表示静态背景,使用神经形状先验建模动态参与者。

- DrivingGaussian:利用高斯溅射将场景分解为增量静态3D高斯和动态高斯图组件。

- StreetGaussian:将3DGS应用于背景和物体,但物体额外附加其历史姿态。

- CoDa-4DGS:采用可变形高斯和上下文特征蒸馏,在4D自动驾驶环境中实现动态场景渲染和基于语义的场景编辑。

- Generative LiDAR Editing:专注于激光雷达点云,使用球面体素化上的背景修复来从静态背景中提取物体。

- DriveEditor:依赖预训练的Segment Anything(SAM)从相机图像推断感兴趣智能体的3D边界框。

编辑与渲染流程 :

一旦学习表示,编辑和渲染过程针对每种方法的骨干网络和场景要求定制。例如,UniSim采用基于体素的神经特征插值方法;DrivingGaussian通过修改表示动态物体或背景元素的高斯基元应用编辑;CoDa-4DGS集成LSeg在2D图像上执行特征蒸馏,通过将这些语义特征光栅化到高斯中并在时间上联合变形,实现语义驱动的操作(如移动、移除、添加高斯)。

7.3 3D场景编辑方法对比

| 方法 | 建模类型 | 插入 | 移除 | 操作 | 相机 | 激光雷达 | 代码 |

|---|---|---|---|---|---|---|---|

| UniSim | NeRF | ✓ | ✓ | ✓ | ✓ | ✓ | N/A |

| DrivingGaussian | 3DGS | ✓ | ✓ | - | ✓ | - | GitHub |

| StreetGaussian | 3DGS | ✓ | ✓ | ✓ | ✓ | - | N/A |

| CoDa-4DGS | 3DGS, LSeg | ✓ | ✓ | ✓ | ✓ | - | N/A |

| Generative LiDAR | 生成式修复 | ✓ | ✓ | ✓ | ✓ | ✓ | N/A |

| DriveEditor | SAM, Video Diffusion | ✓ | ✓ | ✓ | ✓ | - | N/A |

8. 大语言模型:从文本理解到驾驶决策的语言智能

强大LLM的出现彻底改变了多轮对话、指令遵循和推理领域。利用其解释和综合复杂信息的能力,LLM在自动驾驶中展现出巨大潜力。通过处理来自实时传感器和复杂驾驶场景的多样化数据,LLM可增强决策制定、提升安全性并加速高级驾驶辅助系统的采用。

8.1 问答与场景理解

LLM在自动驾驶中的早期应用主要利用其基本能力,将它们用作专家聊天机器人协助感知、预测和规划任务,最终支持决策过程。

典型流程:首先将关键线索(如自车状态或驾驶场景细节)转化为自然语言,然后由LLM处理。LLM随后以问答形式基于这种语言输入生成响应。

代表性系统:

- Dilu:引入知识驱动决策框架,利用LLM进行少样本提示。包含四个核心模块:环境、推理、反思和记忆,协同指导决策过程。

- Drive-Like-A-Human:提出使用GPT-3.5进行元决策的闭环自动驾驶系统,展示类人驾驶能力。

- LaMPilot:利用思维程序(Program-of-Thought)提示技术,增强集成到自动驾驶系统中的大语言模型在感知、预测和规划期间的指令遵循能力。

- LLaDA:引入无需训练的机制,协助人类驾驶员并使自动驾驶策略适应不熟悉环境。

8.2 运动规划:从文本到动作

与问答任务不同,用于规划任务的基于LLM的自动驾驶系统将自动驾驶视为整体序列建模问题,将原始或结构化基于语言的表示直接映射到驾驶动作。最终输出通常包括可执行控制或未来自车状态(如速度、曲率和航路点),使车辆能够在复杂环境中动态自适应导航。

端到端规划系统:

- GPT-driver:基于GPT-3.5强大的推理和泛化能力,通过将输入和输出格式化为语言token,开发端到端自动驾驶运动规划系统。

- Talk2Drive:提出基于LLM的框架,以人在回路方式将自然语言命令转化为可执行控制,使系统能够学习并适应个人偏好。

- Agent-Driver:首个引入智能体框架的系统,转换传统自动驾驶流程,集成多功能工具库、认知记忆和推理引擎。

关键局限 :

尽管取得进展,基于LLM的自动驾驶系统仍面临根本局限:缺乏原生视觉感知模块。因此,它们无法在统一架构内处理完整的感知-动作流程。

| 方法 | 会议/年份 | 交互 | 任务 | 场景 | 骨干网络 | 策略 | 输入 | 输出 | 代码 |

|---|---|---|---|---|---|---|---|---|---|

| Dilu | ArXiv'23 | 提示 | QA | DM | GPT-4 | ReAct | ED | 动作 | GitHub |

| Drive-Like-A-Human | WACV'24 | 提示 | QA | DM | GPT-3.5 | ReAct | ED | 动作 | GitHub |

| Driving-with-LLMs | ICRA'24 | 微调 | QA | SU | LLaMA-7b | None | 问题 | 答案 | GitHub |

| LaMPilot | CVPR'24 | 提示 | QA | SU | General LLMs | PoT | 指令, DC | 代码 | GitHub |

| LLaDA | CVPR'24 | 提示 | QA | DM | GPT-4 | CoT | 预期命令 | 动作 | GitHub |

| GPT-driver | NeurIPS'23 | 微调 | PL | E2E | GPT-3.5 | CoT | 指令, DC | 物体, 动作, 轨迹 | GitHub |

| Talk2Drive | ITSC'24 | 提示 | PL | E2E | GPT-4 | CoT | 指令, DC | 可执行控制 | GitHub |

| Agent-Driver | COLM'24 | 提示 | PL | E2E | GPT-3.5 | ReAct | 观测 | 物体, 动作, 轨迹 | GitHub |

9. 多模态大语言模型:视觉-语言-动作的统一架构

通过集成CLIP等视觉编码器,LLM的强大能力可扩展到视觉域。这些编码器将图像块转换为token,并与文本token嵌入对齐,实现统一的多模态理解。因此,MLLM可无缝处理和推理文本与视觉输入,支持视觉问答(VQA)和图像字幕等任务。这种统一架构也为开发能够有效处理完整感知-动作流程的端到端自动驾驶系统奠定基础。

9.1 感知与预测

通过整合视觉/视频编码器,MLLM可直接处理来自驾驶场景的视觉信息。利用大语言模型的预训练知识,MLLM能够理解复杂驾驶场景、识别关键物体和事件,并执行高级推理分析以支持自动驾驶系统中的决策。

场景理解系统:

- HiLM-D:利用MLLM处理驾驶场景视频,生成同时识别和解释风险物体、理解自车意图并提供运动建议的自然语言,消除对任务特定架构的需求。

- DriveLM:引入图视觉问答(Graph VQA),在问答对中为感知、预测和规划建模图结构推理。

- Dolphins:基于OpenFlamingo构建,通过利用大规模公共VQA数据集增强细粒度视觉推理,并进一步在从BDD-X数据集构建的自定义VQA数据集上训练以适应自动驾驶域。

- DriveVLM:引入基于MLLM的框架,结合思维链(CoT)推理范式,在复杂驾驶环境中实现更复杂的场景理解和决策。

- LLM-Augmented-MTR:利用GPT-4V使用精心设计的提示从可视化图像解释驾驶场景,生成丰富的交通上下文信息,增强传统运动预测算法。

9.2 端到端系统

MLLM强大的推理能力和泛化能力使开发语言引导的端到端自动驾驶系统成为可能。这些系统在统一框架内整合感知、规划和控制。通过利用MLLM,此类系统可解释复杂命令、适应新颖场景,并提供可解释的决策过程。

代表性系统:

- LMDrive:提出新颖的语言引导、端到端、闭环自动驾驶框架,基于LLaVA-v1.5与动态环境交互,使用多模态、多视角传感器数据和自然语言指令。

- LeGo-Drive:提出基于给定语言命令估计目标位置作为端到端设置中中间表示的方法,实现灵活的目标导向导航。

- RAG-Driver:引入新颖的检索增强上下文学习框架,用于基于MLLM的、可泛化且可解释的端到端自动驾驶,展示对先前未见环境的卓越零样本泛化能力。

- DriveVLM-Dual:DriveVLM的混合自动驾驶系统,将DriveVLM的视觉-语言能力与传统的模块化流程集成,增强空间推理并显著改善复杂驾驶场景中的实时决策和规划性能。

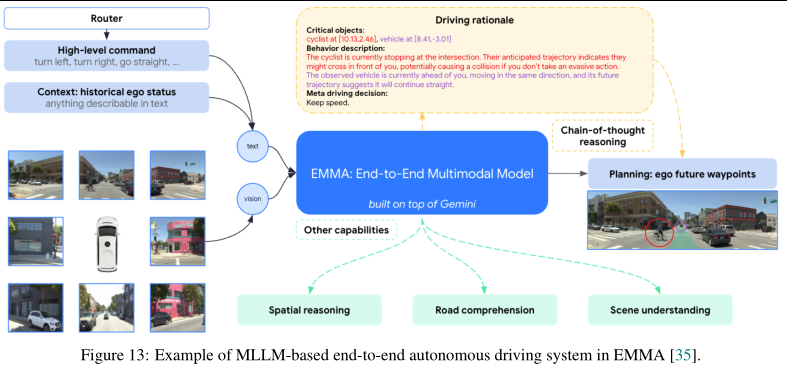

- EMMA:提出统一的基于MLLM的框架,将所有非传感器输入(如导航指令和自车状态)和输出(如规划轨迹和3D物体位置)编码为自然语言表示。这种以语言为中心的设计使不同模态和任务能够在单一通用模型架构内无缝集成。

- OpenEMMA :利用强大的预训练MLLM(如LLaVA-1.6、Qwen2-VL、GPT-4o)构建端到端AD系统,结合CoT推理。设计允许系统首先预测未来自车速度和曲率,然后积分推导未来航路点,在零样本、无需训练的情况下实现竞争性性能。

| 方法 | 会议/年份 | 交互 | 任务 | 场景 | 骨干网络 | 策略 | 输入 | 输出 | 代码 |

|---|---|---|---|---|---|---|---|---|---|

| HiLM-D | ArXiv'23 | 提示 | VQA | SU | MiniGPT-4 | None | 问题, DS (视频) | 答案 | N/A |

| DriveLM | ECCV'24 | 微调 | VQA | SU | BLIP-2 | CoT | 问题, DS (图像) | 答案 | GitHub |

| Dolphins | ECCV'24 | 微调 | VQA | SU | OpenFlamingo | CoT | 问题, DS (视频) | 答案 | GitHub |

| EM-VLM4AD | CVPR'24 | 微调 | VQA | SU | T5/T5-Large | None | 问题, DS (MVF) | 答案 | GitHub |

| LLM-Augmented-MTR | IROS'24 | 提示 | VQA | SU | GPT-4V | CoT | 指令, TC-Map | 上下文理解 | GitHub |

| LMDrive | CVPR'24 | 微调 | PL | E2E | LLaVA-v1.5 | CoT | 指令, DS (MVF), LiDAR | 控制信号 | GitHub |

| LeGo-Drive | IROS'24 | 微调 | PL | E2E | CLIP | None | 指令, DS (图像) | 轨迹 | GitHub |

| RAG-Driver | ArXiv'24 | 微调 | PL | E2E | ViT-B/32, Vicuna-1.5 | RAG | 指令, DS (视频) | 动作, 轨迹 | GitHub |

| DriveVLM | CoRL'24 | 微调 | PL | E2E | Qwen-VL | CoT | 指令, DS (视频) | 动作, 轨迹 | N/A |

| EMMA | ArXiv'24 | 微调 | PL | E2E | Gemini 1.0 Nano-1 | CoT | 指令, DS (MVF) | 物体, 动作, 轨迹 | N/A |

| OpenDriveVLA | ArXiv'25 | 微调 | PL | E2E | Qwen2.5 | None | 指令, DS (MVF) | 动作, 轨迹 | GitHub |

| OpenEMMA | WACV'25 | 提示 | PL | E2E | General MLLMs | CoT | 指令, DS (图像) | 物体, 动作, 轨迹 | GitHub |

结语与下篇预告

本章系统梳理了生成式AI在自动驾驶各核心模态中的前沿应用:从图像合成的可控性与分解式生成,到激光雷达点云的神经渲染;从轨迹预测的多模态建模到占用栅格的时空推演;从视频生成的时序一致性到3D/4D场景的重建与编辑;再到大语言模型与多模态大语言模型对自动驾驶决策范式的根本性重塑。

这些技术共同构成了生成式自动驾驶的技术图谱:在数据层,通过合成数据解决长尾问题;在感知层,通过NeRF/3DGS实现几何精确的环境理解;在预测层,通过扩散模型捕获多智能体交互的不确定性;在决策层,通过MLLM实现语言 grounded 的端到端规划。

专栏下篇预告:《从仿真到现实:生成式AI在自动驾驶的落地实践------合成数据引擎、端到端系统与数字孪生》

敬请期待第5章的应用实践篇,我们将深入探讨生成式AI如何从实验室走向工程化落地:如何构建大规模合成数据流水线训练感知模型?端到端自动驾驶系统如何整合生成式世界模型?数字孪生技术如何实现Real2Sim2Real的闭环验证?我们将提供详实的系统架构与落地路径分析。