【TJU】研究生应用统计学课程笔记(8)------第四章 线性模型(4.1 一元线性回归分析)

- [4.1 一元线性回归分析](#4.1 一元线性回归分析)

-

-

- [1️⃣ 变量之间的关系和回归分析研究的主要内容](#1️⃣ 变量之间的关系和回归分析研究的主要内容)

- [2️⃣ 一元线性回归模型](#2️⃣ 一元线性回归模型)

- [3️⃣ 最小二乘估计](#3️⃣ 最小二乘估计)

- [4️⃣ 回归系数最小二乘估计量的性质](#4️⃣ 回归系数最小二乘估计量的性质)

- [5️⃣ 残差平方和](#5️⃣ 残差平方和)

- [6️⃣ 随机误差 ε \varepsilon ε 的方差 σ 2 \sigma^2 σ2 的估计](#6️⃣ 随机误差 ε \varepsilon ε 的方差 σ 2 \sigma^2 σ2 的估计)

- [7️⃣ 回归方程的显著性检验](#7️⃣ 回归方程的显著性检验)

- [8️⃣ 定理](#8️⃣ 定理)

- [9️⃣ 回归方程的显著性检验方法](#9️⃣ 回归方程的显著性检验方法)

- [🔟 预测问题](#🔟 预测问题)

- [1️⃣1️⃣ 控制问题](#1️⃣1️⃣ 控制问题)

- [1️⃣2️⃣ 例题](#1️⃣2️⃣ 例题)

-

4.1 一元线性回归分析

1️⃣ 变量之间的关系和回归分析研究的主要内容

变量之间的关系一般分为两类:

-

(1) 完全确定的关系,也就是变量之间的关系可以用函数解析式表达出来;如 y = f ( x ) y = f(x) y=f(x)

-

(2) 非确定的关系, y y y 与 x x x 的取值有关,但不能完全确定,也称为相关关系。

回归分析研究的主要内容:

-

(1) 通过观察或实验数据的处理,找出变量间相关关系的定量数学表达式------经验公式,即进行参数估计,并确定经验回归方程的具体形式;

-

(2) 检验所建立的经验回归方程是否合理;

-

(3) 利用合理的回归方程对随机变量 Y Y Y 进行预测和控制;

-

(4) 进行因素分析,找出影响一变量的各因素的主次。

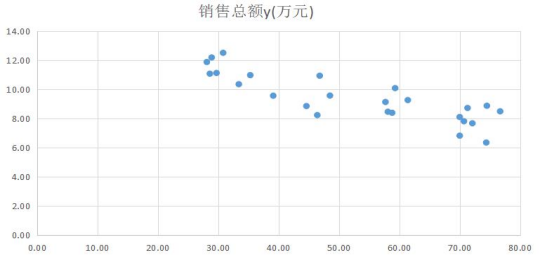

例1: 为研究商品价格与销售量之间的关系,现在收集了某商品在一个地区 25 个时间段内平均价格 x x x(元)和销售总额 y y y(万元),试研究 y y y 与 x x x 之间的关系。

| x x x | 35.3 | 29.7 | 30.8 | 58.8 | 61.4 | 71.3 | 74.4 | 76.7 | 70.7 |

|---|---|---|---|---|---|---|---|---|---|

| y y y | 10.98 | 11.13 | 12.51 | 8.40 | 9.27 | 8.73 | 6.36 | 8.50 | 7.82 |

| x x x | 46.4 | 28.9 | 28.1 | 39.1 | 46.8 | 48.5 | 59.3 | 70.0 | 70.0 |

| y y y | 8.24 | 12.19 | 11.88 | 9.57 | 10.94 | 9.58 | 10.09 | 8.11 | 6.83 |

| x x x | 72.1 | 58.1 | 44.6 | 33.4 | 28.6 | 57.7 | 74.5 | ||

| y y y | 7.68 | 8.47 | 8.86 | 10.36 | 11.08 | 9.14 | 8.88 |

-

通过回归分析可以确定价格与销售额之间的关系

-

通过价格对销售额进行预测

-

调控价格以达到理想的销售额

2️⃣ 一元线性回归模型

定义: 设回归变量 x x x 与响应变量(因变量) y y y 之间有这样的关系:

y = β 0 + β 1 x + ϵ y = \beta_0 + \beta_1 x + \epsilon y=β0+β1x+ϵ

其中 β 0 , β 1 \beta_0, \beta_1 β0,β1 是未知参数, ϵ \epsilon ϵ 是随机项,且假定 E ( ϵ ) = 0 , D ( ϵ ) = σ 2 E(\epsilon) = 0, D(\epsilon) = \sigma^2 E(ϵ)=0,D(ϵ)=σ2,则称此模型为一元线性回归模型。

若 ϵ ∼ N ( 0 , σ 2 ) \epsilon \sim N(0, \sigma^2) ϵ∼N(0,σ2),则称为一元正态线性回归模型。

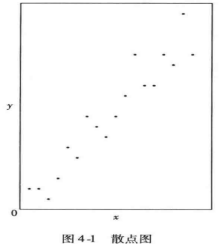

设 n n n 次试验的观测值为 ( x 1 , y 1 ) , ( x 2 , y 2 ) , ⋯ , ( x n , y n ) (x_1, y_1), (x_2, y_2), \cdots, (x_n, y_n) (x1,y1),(x2,y2),⋯,(xn,yn)。将它们在直角坐标系中标出,称这样的图为散点图。

设观测值 y i y_i yi 与 x i x_i xi 的关系为: { y i = β 0 + β 1 x i + ϵ i , E ( ϵ i ) = 0 , V a r ( ϵ i ) = σ 2 ( i = 1 , 2 , ⋯ , n ) ϵ 1 , ϵ 2 , ⋯ , ϵ n 两两不相关 \begin{cases} y_i = \beta_0 + \beta_1 x_i + \epsilon_i, \\ E(\epsilon_i) = 0, Var(\epsilon_i) = \sigma^2 \quad (i = 1, 2, \cdots, n) \\ \epsilon_1, \epsilon_2, \cdots, \epsilon_n \text{ 两两不相关} \end{cases} ⎩ ⎨ ⎧yi=β0+β1xi+ϵi,E(ϵi)=0,Var(ϵi)=σ2(i=1,2,⋯,n)ϵ1,ϵ2,⋯,ϵn 两两不相关,这是一个线性模型。

我们希望选取一条回归直线 y ~ = β 0 + β 1 x \tilde{y} = \beta_0 + \beta_1 x y~=β0+β1x 使它最接近这 n n n 个点。须估计其中的未知参数 β 0 \beta_0 β0 和 β 1 \beta_1 β1记 β 0 \beta_0 β0 和 β 1 \beta_1 β1 的估计值为 β ^ 0 , β ^ 1 \hat{\beta}_0, \hat{\beta}_1 β^0,β^1称为回归系数。

而方程 y ^ = β ^ 0 + β ^ 1 x \hat{y} = \hat{\beta}_0 + \hat{\beta}_1 x y^=β^0+β^1x 为一元线性回归方程,其图像称为回归直线,称 y ^ i = β ^ 0 + β ^ 1 x i , i = 1 , ⋯ , n \hat{y}_i = \hat{\beta}_0 + \hat{\beta}_1 x_i, i = 1, \cdots, n y^i=β^0+β^1xi,i=1,⋯,n 为回归值。

3️⃣ 最小二乘估计

对于每一个 x i x_i xi,可以得到回归直线 y ~ = β 0 + β 1 x \tilde{y} = \beta_0 + \beta_1 x y~=β0+β1x 上的点 y ~ i \tilde{y}_i y~i。 ∣ y i − y ~ i ∣ |y_i - \tilde{y}_i| ∣yi−y~i∣ 越小,回归直线拟合越好。

所有观测值 y i y_i yi 与 y ~ i \tilde{y}_i y~i 的偏离的平方和为:

Q ( β 0 , β 1 ) = ∑ i = 1 n ( y i − y ~ i ) 2 = ∑ i = 1 n ( y i − β 0 − β 1 x i ) 2 Q(\beta_0, \beta_1) = \sum_{i=1}^{n} (y_i - \tilde{y}i)^2 = \sum{i=1}^{n} (y_i - \beta_0 - \beta_1 x_i)^2 Q(β0,β1)=i=1∑n(yi−y~i)2=i=1∑n(yi−β0−β1xi)2

求参数 β 0 , β 1 \beta_0, \beta_1 β0,β1 的值使得 Q Q Q 达到最小值,这种求估计量的方法称为最小二乘法。

计算 Q ( β 0 , β 1 ) Q(\beta_0, \beta_1) Q(β0,β1) 关于 β 0 , β 1 \beta_0, \beta_1 β0,β1 的偏导数 ∂ Q ∂ β 0 , ∂ Q ∂ β 1 \frac{\partial Q}{\partial \beta_0}, \frac{\partial Q}{\partial \beta_1} ∂β0∂Q,∂β1∂Q,并令它们等于 0: { ∂ Q ∂ β 0 = − 2 ∑ i = 1 n ( y i − β 0 − β 1 x i ) = 0 ; ∂ Q ∂ β 1 = − 2 ∑ i = 1 n ( y i − β 0 − β 1 x i ) x i = 0. \begin{cases} \frac{\partial Q}{\partial \beta_0} = -2 \sum_{i=1}^{n} (y_i - \beta_0 - \beta_1 x_i) = 0; \\ \frac{\partial Q}{\partial \beta_1} = -2 \sum_{i=1}^{n} (y_i - \beta_0 - \beta_1 x_i)x_i = 0. \end{cases} {∂β0∂Q=−2∑i=1n(yi−β0−β1xi)=0;∂β1∂Q=−2∑i=1n(yi−β0−β1xi)xi=0.此方程组称为正规方程组。

得方程组: { n β 0 + β 1 ∑ i = 1 n x i = ∑ i = 1 n y i ; β 0 ∑ i = 1 n x i + β 1 ∑ i = 1 n x i 2 = ∑ i = 1 n x i y i , \begin{cases} n\beta_0 + \beta_1 \sum_{i=1}^{n} x_i = \sum_{i=1}^{n} y_i; \\ \beta_0 \sum_{i=1}^{n} x_i + \beta_1 \sum_{i=1}^{n} x_i^2 = \sum_{i=1}^{n} x_i y_i, \end{cases} {nβ0+β1∑i=1nxi=∑i=1nyi;β0∑i=1nxi+β1∑i=1nxi2=∑i=1nxiyi,

解得: β ^ 0 = y ˉ − β ^ 1 x ˉ \hat{\beta}0 = \bar{y} - \hat{\beta}1 \bar{x} β^0=yˉ−β^1xˉ, β ^ 1 = ∑ i = 1 n x i y i − n x ˉ y ˉ ∑ i = 1 n x i 2 − n x ˉ 2 = ∑ i = 1 n ( x i − x ˉ ) ( y i − y ˉ ) ∑ i = 1 n ( x i − x ˉ ) 2 \hat{\beta}1 = \frac{\sum{i=1}^{n} x_i y_i - n\bar{x}\bar{y}}{\sum{i=1}^{n} x_i^2 - n\bar{x}^2} = \frac{\sum{i=1}^{n} (x_i - \bar{x})(y_i - \bar{y})}{\sum_{i=1}^{n} (x_i - \bar{x})^2} β^1=∑i=1nxi2−nxˉ2∑i=1nxiyi−nxˉyˉ=∑i=1n(xi−xˉ)2∑i=1n(xi−xˉ)(yi−yˉ)。

记: x ˉ = 1 n ∑ i = 1 n x i , y ˉ = 1 n ∑ i = 1 n y i \bar{x} = \frac{1}{n} \sum_{i=1}^{n} x_i, \quad \bar{y} = \frac{1}{n} \sum_{i=1}^{n} y_i xˉ=n1∑i=1nxi,yˉ=n1∑i=1nyi:

S y y = ∑ i = 1 n ( y i − y ˉ ) 2 , S x y = ∑ i = 1 n ( x i − x ˉ ) ( y i − y ˉ ) , S x x = ∑ i = 1 n ( x i − x ˉ ) 2 S_{yy} = \sum_{i=1}^{n} (y_i - \bar{y})^2, \quad S_{xy} = \sum_{i=1}^{n} (x_i - \bar{x})(y_i - \bar{y}), \quad S_{xx} = \sum_{i=1}^{n} (x_i - \bar{x})^2 Syy=i=1∑n(yi−yˉ)2,Sxy=i=1∑n(xi−xˉ)(yi−yˉ),Sxx=i=1∑n(xi−xˉ)2

则 β ^ 1 = S x y S x x , β ^ 0 = y ˉ − β ^ 1 x ˉ \hat{\beta}1 = \frac{S{xy}}{S_{xx}}, \hat{\beta}_0 = \bar{y} - \hat{\beta}_1 \bar{x} β^1=SxxSxy,β^0=yˉ−β^1xˉ 分别称为 β 0 , β 1 \beta_0, \beta_1 β0,β1 的最小二乘估计 ,这种方法称为最小二乘法 , y ^ = β ^ 0 + β ^ 1 x \hat{y} = \hat{\beta}_0 + \hat{\beta}_1 x y^=β^0+β^1x 为经验回归直线。

∵ y ˉ = β ^ 0 + β ^ 1 x ˉ \because \bar{y} = \hat{\beta}_0 + \hat{\beta}_1 \bar{x} ∵yˉ=β^0+β^1xˉ,说明经验回归直线必经过散点图的几何重心 ( x ˉ , y ˉ ) (\bar{x}, \bar{y}) (xˉ,yˉ)。

4️⃣ 回归系数最小二乘估计量的性质

性质 1:对于一元线性回归模型有:

-

(1) E ( β ^ 0 ) = β 0 , E ( β ^ 1 ) = β 1 E(\hat{\beta}_0) = \beta_0, E(\hat{\beta}_1) = \beta_1 E(β^0)=β0,E(β^1)=β1,即 β ^ 0 , β ^ 1 \hat{\beta}_0, \hat{\beta}_1 β^0,β^1 分别是 β 0 , β 1 \beta_0, \beta_1 β0,β1 的无偏估计;

-

(2) V a r ( β ^ 0 ) = ( 1 n + x ˉ 2 S x x ) σ 2 = ∑ i = 1 n x i 2 n S x x σ 2 Var(\hat{\beta}0) = (\frac{1}{n} + \frac{\bar{x}^2}{S{xx}})\sigma^2 = \frac{\sum_{i=1}^n x_i^2}{nS_{xx}}\sigma^2 Var(β^0)=(n1+Sxxxˉ2)σ2=nSxx∑i=1nxi2σ2, V a r ( β ^ 1 ) = σ 2 S x x , C o v ( β ^ 0 , β ^ 1 ) = − x ˉ S x x σ 2 Var(\hat{\beta}1) = \frac{\sigma^2}{S{xx}}, Cov(\hat{\beta}_0, \hat{\beta}1) = -\frac{\bar{x}}{S{xx}}\sigma^2 Var(β^1)=Sxxσ2,Cov(β^0,β^1)=−Sxxxˉσ2

性质 2: C o v ( β ^ 1 , y ˉ ) = 0 Cov(\hat{\beta}_1, \bar{y}) = 0 Cov(β^1,yˉ)=0,即 β ^ 1 \hat{\beta}_1 β^1 与 y ˉ \bar{y} yˉ 不相关。

性质 3: β ^ 0 , β ^ 1 \hat{\beta}_0, \hat{\beta}_1 β^0,β^1 分别是 β 0 , β 1 \beta_0, \beta_1 β0,β1 的最小方差线性无偏估计(BLUE)。

5️⃣ 残差平方和

y ^ i = β ^ 0 + β ^ 1 x i , i = 1 , ⋯ , n \hat{y}_i = \hat{\beta}_0 + \hat{\beta}_1 x_i, i = 1, \cdots, n y^i=β^0+β^1xi,i=1,⋯,n 为回归值,则称 ϵ ^ i = y i − y ^ i \hat{\epsilon}_i = y_i - \hat{y}_i ϵ^i=yi−y^i 为第 i i i 个残差, i = 1 , ⋯ , n i = 1, \cdots, n i=1,⋯,n。定义

Q e = ∑ i = 1 n ϵ ^ i 2 = ∑ i = 1 n ( y i − y ^ i ) 2 = ∑ i = 1 n ( y i − β ^ 0 − β ^ 1 x i ) 2 Q_e = \sum_{i=1}^{n} \hat{\epsilon}i^2 = \sum{i=1}^{n} (y_i - \hat{y}i)^2 = \sum{i=1}^{n} (y_i - \hat{\beta}_0 - \hat{\beta}_1 x_i)^2 Qe=i=1∑nϵ^i2=i=1∑n(yi−y^i)2=i=1∑n(yi−β^0−β^1xi)2

为残差平方和,它代表 y i y_i yi 与经验回归直线上点的纵坐标 y ^ i \hat{y}_i y^i 的离差平方和,反映了试验的随机误差。

将 β ^ 0 = y ˉ − β ^ 1 x ˉ \hat{\beta}_0 = \bar{y} - \hat{\beta}_1 \bar{x} β^0=yˉ−β^1xˉ 代入上式:

Q e = ∑ i = 1 n ( y i − y ˉ ) 2 + β ^ 1 2 ∑ i = 1 n ( x i − x ˉ ) 2 − 2 β ^ 1 ∑ i = 1 n ( x i − x ˉ ) ( y i − y ˉ ) Q_e = \sum_{i=1}^{n} (y_i - \bar{y})^2 + \hat{\beta}1^2 \sum{i=1}^{n} (x_i - \bar{x})^2 - 2\hat{\beta}1 \sum{i=1}^{n} (x_i - \bar{x})(y_i - \bar{y}) Qe=i=1∑n(yi−yˉ)2+β^12i=1∑n(xi−xˉ)2−2β^1i=1∑n(xi−xˉ)(yi−yˉ) = S y y + β ^ 1 2 S x x − 2 β ^ 1 S x y = S y y − β ^ 1 S x y = S y y − S x y 2 S x x = S_{yy} + \hat{\beta}1^2 S{xx} - 2\hat{\beta}1 S{xy} = S_{yy} - \hat{\beta}1 S{xy} = S_{yy} - \frac{S_{xy}^2}{S_{xx}} =Syy+β^12Sxx−2β^1Sxy=Syy−β^1Sxy=Syy−SxxSxy2

其中 ∵ β ^ 1 = S x y S x x \because \hat{\beta}1 = \frac{S{xy}}{S_{xx}} ∵β^1=SxxSxy

6️⃣ 随机误差 ε \varepsilon ε 的方差 σ 2 \sigma^2 σ2 的估计

Q e = S y y − β ^ 1 S x y Q_e = S_{yy} - \hat{\beta}1 S{xy} Qe=Syy−β^1Sxy,令 σ ^ 2 = Q e n − 2 = S y y − β ^ 1 S x y n − 2 \hat{\sigma}^2 = \frac{Q_e}{n-2} = \frac{S_{yy} - \hat{\beta}1 S{xy}}{n-2} σ^2=n−2Qe=n−2Syy−β^1Sxy 作为 σ 2 \sigma^2 σ2 的一个估计量。

性质 4: σ ^ 2 = Q e n − 2 \hat{\sigma}^2 = \frac{Q_e}{n-2} σ^2=n−2Qe 为 σ 2 \sigma^2 σ2 的无偏估计;

7️⃣ 回归方程的显著性检验

对任意给定的一组数据 ( x 1 , y 1 ) , ( x 2 , y 2 ) , ⋯ , ( x n , y n ) (x_1, y_1), (x_2, y_2), \cdots, (x_n, y_n) (x1,y1),(x2,y2),⋯,(xn,yn),都可以得到回归直线: y ^ = β ^ 0 + β ^ 1 x \hat{y} = \hat{\beta}_0 + \hat{\beta}_1 x y^=β^0+β^1x

但这并不说明 y y y 和 x x x 之间确实存在线性关系,有必要对回归方程的显著性进行检验: H 0 : β 1 = 0 ↔ H 1 : β 1 ≠ 0 H_0 : \beta_1 = 0 \leftrightarrow H_1 : \beta_1 \neq 0 H0:β1=0↔H1:β1=0

-

当 H 0 H_0 H0 成立时:说明 y y y 与 x x x 之间无线性相关关系;

-

当 H 0 H_0 H0 不成立时:说明 y y y 与 x x x 之间线性相关关系显著。

对数据 ( x 1 , y 1 ) , ( x 2 , y 2 ) , ⋯ , ( x n , y n ) (x_1, y_1), (x_2, y_2), \cdots, (x_n, y_n) (x1,y1),(x2,y2),⋯,(xn,yn),得到回归直线 y ^ = β ^ 0 + β ^ 1 x \hat{y} = \hat{\beta}0 + \hat{\beta}1 x y^=β^0+β^1x如果回归直线对数据拟合效果很好,观测值 y i y_i yi 与回归值 y ^ i \hat{y}i y^i 的差,即残差 ϵ ^ i \hat{\epsilon}i ϵ^i 比较小,可以认为 y y y 和 x x x 之间确实存在线性关系。考察数据的总离差平方和 S y y S{yy} Syy,并将其分解: S y y = ∑ i = 1 n ( y i − y ˉ ) 2 = ∑ i = 1 n [ ( y i − y ^ i ) + ( y ^ i − y ˉ ) ] 2 = ∑ i = 1 n ( y i − y ^ i ) 2 + ∑ i = 1 n ( y ^ i − y ˉ ) 2 + 2 ∑ i = 1 n ( y i − y ^ i ) ( y ^ i − y ˉ ) , S{yy} = \sum{i=1}^{n} (y_i - \bar{y})^2 = \sum{i=1}^{n} [(y_i - \hat{y}_i) + (\hat{y}i - \bar{y})]^2 \\ = \sum{i=1}^{n} (y_i - \hat{y}i)^2 + \sum{i=1}^{n} (\hat{y}i - \bar{y})^2 + 2 \sum{i=1}^{n} (y_i - \hat{y}_i)(\hat{y}_i - \bar{y}), Syy=i=1∑n(yi−yˉ)2=i=1∑n[(yi−y^i)+(y^i−yˉ)]2=i=1∑n(yi−y^i)2+i=1∑n(y^i−yˉ)2+2i=1∑n(yi−y^i)(y^i−yˉ),

y ^ i = β ^ 0 + β ^ 1 x i = y ˉ + β ^ 1 ( x i − x ˉ ) , \hat{y}_i = \hat{\beta}_0 + \hat{\beta}_1 x_i = \bar{y} + \hat{\beta}_1 (x_i - \bar{x}), y^i=β^0+β^1xi=yˉ+β^1(xi−xˉ),

∑ i = 1 n ( y i − y ^ i ) ( y ^ i − y ˉ ) = ∑ i = 1 n [ y i − y ˉ − β ^ 1 ( x i − x ˉ ) ] β ^ 1 ( x i − x ˉ ) = β ^ 1 S x y − β ^ 1 2 S x x = 0. \begin{aligned} \sum_{i=1}^{n} (y_i - \hat{y}_i)(\hat{y}i - \bar{y}) &= \sum{i=1}^{n} [y_i - \bar{y} - \hat{\beta}_1 (x_i - \bar{x}) ] \hat{\beta}_1 (x_i - \bar{x}) \\ &= \hat{\beta}1 S{xy} - \hat{\beta}1^2 S{xx} = 0. \end{aligned} i=1∑n(yi−y^i)(y^i−yˉ)=i=1∑n[yi−yˉ−β^1(xi−xˉ)]β^1(xi−xˉ)=β^1Sxy−β^12Sxx=0.

核心结论: S y y = ∑ i = 1 n ( y i − y ^ i ) 2 + ∑ i = 1 n ( y ^ i − y ˉ ) 2 ≜ Q e + U S_{yy} = \sum_{i=1}^{n} (y_i - \hat{y}i)^2 + \sum{i=1}^{n} (\hat{y}_i - \bar{y})^2 \triangleq Q_e + U Syy=i=1∑n(yi−y^i)2+i=1∑n(y^i−yˉ)2≜Qe+U

其中 Q e = ∑ i = 1 n ( y i − y ^ i ) 2 Q_e = \sum_{i=1}^{n} (y_i - \hat{y}i)^2 Qe=∑i=1n(yi−y^i)2, U = ∑ i = 1 n ( y ^ i − y ˉ ) 2 = ∑ i = 1 n ( β ^ 0 + β ^ 1 x i − β ^ 0 − β ^ 1 x ˉ ) 2 = β ^ 1 2 S x x U = \sum{i=1}^{n} (\hat{y}i - \bar{y})^2 = \sum{i=1}^{n} (\hat{\beta}_0 + \hat{\beta}_1 x_i - \hat{\beta}_0 - \hat{\beta}1 \bar{x})^2 = \hat{\beta}1^2 S{xx} U=∑i=1n(y^i−yˉ)2=∑i=1n(β^0+β^1xi−β^0−β^1xˉ)2=β^12Sxx。 S y y S{yy} Syy 为总的离差平方和, U U U 为回归平方和,表示回归值 y ^ i \hat{y}_i y^i 的波动, Q e Q_e Qe 为剩余(残差)平方和,反映了随机误差的存在而引起的因变量的波动。

8️⃣ 定理

若随机误差 ϵ ∼ N ( 0 , σ 2 ) \epsilon \sim N(0, \sigma^2) ϵ∼N(0,σ2),则:

-

(1) β ^ 1 ∼ N ( β 1 , σ 2 S x x ) \hat{\beta}1 \sim N(\beta_1, \frac{\sigma^2}{S{xx}}) β^1∼N(β1,Sxxσ2)

-

(2) β ^ 0 ∼ N ( β 0 , ( 1 n + x ˉ 2 S x x ) σ 2 ) \hat{\beta}0 \sim N(\beta_0, (\frac{1}{n} + \frac{\bar{x}^2}{S{xx}})\sigma^2) β^0∼N(β0,(n1+Sxxxˉ2)σ2)

-

(3) Q e σ 2 ∼ χ 2 ( n − 2 ) \frac{Q_e}{\sigma^2} \sim \chi^2(n - 2) σ2Qe∼χ2(n−2), Q e Q_e Qe 与 β ^ 1 \hat{\beta}_1 β^1 相互独立

-

(4) 在 H 0 ( β 1 = 0 ) H_0 (\beta_1 = 0) H0(β1=0) 成立条件下, U σ 2 ∼ χ 2 ( 1 ) \frac{U}{\sigma^2} \sim \chi^2(1) σ2U∼χ2(1), F = U Q e / ( n − 2 ) = ( n − 2 ) U Q e ∼ F ( 1 , n − 2 ) F = \frac{U}{Q_e / (n - 2)} = (n - 2) \frac{U}{Q_e} \sim F(1, n - 2) F=Qe/(n−2)U=(n−2)QeU∼F(1,n−2)

-

(5) β ^ 1 − β 1 σ ^ S x x ∼ t ( n − 2 ) \frac{\hat{\beta}1 - \beta_1}{\hat{\sigma}} \sqrt{S{xx}} \sim t(n - 2) σ^β^1−β1Sxx ∼t(n−2),其中 σ ^ 2 = Q e n − 2 \hat{\sigma}^2 = \frac{Q_e}{n - 2} σ^2=n−2Qe

9️⃣ 回归方程的显著性检验方法

设 ϵ ∼ N ( 0 , σ 2 ) \epsilon \sim N(0, \sigma^2) ϵ∼N(0,σ2):

1. F检验法 :统计量 F = ( n − 2 ) U Q e ∼ H 0 F ( 1 , n − 2 ) F = (n - 2)\frac{U}{Q_e} \overset{H_0}{\sim} F(1, n - 2) F=(n−2)QeU∼H0F(1,n−2),对给定的显著性水平 α \alpha α,拒绝域为: W = { f > F 1 − α ( 1 , n − 2 ) } W = \{f > F_{1-\alpha}(1, n - 2)\} W={f>F1−α(1,n−2)}

2. t检验法 : T = β ^ 1 S x x σ ^ ∼ H 0 t ( n − 2 ) T = \frac{\hat{\beta}1 \sqrt{S{xx}}}{\hat{\sigma}} \overset{H_0}{\sim} t(n - 2) T=σ^β^1Sxx ∼H0t(n−2),对给定的显著性水平 α \alpha α,拒绝域为: W = { ∣ t ∣ > t 1 − α 2 ( n − 2 ) } W = \{|t| > t_{1-\frac{\alpha}{2}}(n - 2)\} W={∣t∣>t1−2α(n−2)}

3. 相关系数检验法(判定系数法):

R = S x y S x x S y y = β ^ 1 S x x S y y , R 2 = β ^ 1 2 S x x S y y R = \frac{S_{xy}}{\sqrt{S_{xx}S_{yy}}} = \hat{\beta}1 \sqrt{\frac{S{xx}}{S_{yy}}}, \quad R^2 = \hat{\beta}1^2 \frac{S{xx}}{S_{yy}} R=SxxSyy Sxy=β^1SyySxx ,R2=β^12SyySxx

-

R R R: 线性相关系数; R 2 R^2 R2: 相关指数(判定系数)。

-

性质: ∣ R ∣ , R 2 |R|, R^2 ∣R∣,R2 越接近 1,说明线性相关程度越高。

-

检验: 对给定的显著性水平 α \alpha α,拒绝域为 W = { ∣ R ∣ > c } W = \{|R| > c\} W={∣R∣>c}。

注:

(1) 当落入拒绝域时,拒绝 H 0 H_0 H0,即认为 y y y 与 x x x 之间线性关系显著,或者说回归方程是有意义的;

(2) 否则认为回归方程不合理,这种情况由多种原因引起:自变量 X X X 对 Y Y Y 的影响确实不大还有对 Y Y Y 有更重要影响的自变量没有被考虑整个系统误差过大 Y Y Y 与 X X X 有关系,但不是线性关系,不适合线性回归

(3) R 2 = U / S y y R^2 = U/S_{yy} R2=U/Syy:回归平方和在总离差平方和中的比例, T , F , R 2 T, F, R^2 T,F,R2 之间的关系: Q e = S y y − S x y 2 S x x = S y y ( 1 − S x y 2 S x x S y y ) = S y y ( 1 − R 2 ) , Q_e = S_{yy} - \frac{S_{xy}^2}{S_{xx}} = S_{yy}(1 - \frac{S_{xy}^2}{S_{xx}S_{yy}}) = S_{yy}(1 - R^2), Qe=Syy−SxxSxy2=Syy(1−SxxSyySxy2)=Syy(1−R2), U = S y y − Q e = R 2 S y y , ∴ F = ( n − 2 ) R 2 1 − R 2 , U = S_{yy} - Q_e = R^2 S_{yy}, \quad \therefore F = (n - 2)\frac{R^2}{1 - R^2}, U=Syy−Qe=R2Syy,∴F=(n−2)1−R2R2, T 2 = F = ( n − 2 ) R 2 1 − R 2 , T^2 = F = (n - 2)\frac{R^2}{1 - R^2}, T2=F=(n−2)1−R2R2,故三种检验在本质上是一致的,大部分软件都采用 F 检验。

🔟 预测问题

1. 点预测 :当给定 x 0 x_0 x0 时, y ^ 0 = β ^ 0 + β ^ 1 x 0 \hat{y}_0 = \hat{\beta}_0 + \hat{\beta}_1 x_0 y^0=β^0+β^1x0 就是 y 0 y_0 y0 的点预测。

2. 区间预测 :当给定 x 0 x_0 x0 时, y 0 y_0 y0 的置信度为 1 − α 1 - \alpha 1−α 的置信区间,称为预测区间,即寻找 y 1 , y 2 y_1, y_2 y1,y2,使 P { y 1 ≤ y 0 ≤ y 2 } = 1 − α P\{y_1 \le y_0 \le y_2\} = 1 - \alpha P{y1≤y0≤y2}=1−α。当 ϵ ∼ N ( 0 , σ 2 ) \epsilon \sim N(0, \sigma^2) ϵ∼N(0,σ2), y 0 y_0 y0 的置信水平为 1 − α 1 - \alpha 1−α 的置信区间(即预测区间)为:

y \^ 0 − δ ( x 0 ) , y \^ 0 + δ ( x 0 ) \] \[\\hat{y}_0 - \\delta(x_0), \\hat{y}_0 + \\delta(x_0)\] \[y\^0−δ(x0),y\^0+δ(x0)

其中: δ ( x 0 ) = σ ^ t 1 − α 2 ( n − 2 ) 1 + 1 n + ( x 0 − x ˉ ) 2 S x x \delta(x_0) = \hat{\sigma} t_{1 - \frac{\alpha}{2}}(n - 2) \sqrt{1 + \frac{1}{n} + \frac{(x_0 - \bar{x})^2}{S_{xx}}} δ(x0)=σ^t1−2α(n−2)1+n1+Sxx(x0−xˉ)2 , σ ^ 2 = Q e n − 2 \hat{\sigma}^2 = \frac{Q_e}{n-2} σ^2=n−2Qe, S x x = ∑ i = 1 n ( x i − x ˉ ) 2 S_{xx} = \sum_{i=1}^{n} (x_i - \bar{x})^2 Sxx=∑i=1n(xi−xˉ)2

注:

- (1) 这个区间长度为 2 δ 0 2\delta_0 2δ0,中心在 y ^ 0 \hat{y}0 y^0。当 n , α n, \alpha n,α 固定时, Q e Q_e Qe 越小(残差小)、 S x x S{xx} Sxx 越大(自变量分布越广),可以提高预测精度。

- (2) 由样本观测值可以作两条曲线 y 1 ( x ) = y ^ ( x ) − δ ( x ) y_1(x) = \hat{y}(x) - \delta(x) y1(x)=y^(x)−δ(x) 和 y 2 ( x ) = y ^ ( x ) + δ ( x ) y_2(x) = \hat{y}(x) + \delta(x) y2(x)=y^(x)+δ(x)。这两条曲线把回归直线 y ^ ( x ) = β 0 + β 1 x \hat{y}(x) = \beta_0 + \beta_1 x y^(x)=β0+β1x 夹在中间,形成一条宽窄不等的区域,这个区域在 x = x ˉ x = \bar{x} x=xˉ(均值处)最窄。

- (3) 在利用回归方程进行预测时,样本容量不能太小,因为小样本也许不能真实反映变量之间的结构关系。

- (4) 当 n n n 很大时, t 1 − α 2 ( n − 2 ) ≈ u 1 − α 2 t_{1-\frac{\alpha}{2}}(n - 2) \approx u_{1-\frac{\alpha}{2}} t1−2α(n−2)≈u1−2α(正态分布分位数)。若 x ˉ \bar{x} xˉ 离 x 0 x_0 x0 不太远, y 0 y_0 y0 的置信水平近似为 1 − α 1 - \alpha 1−α 的置信区间(即预测区间)为: [ y ^ 0 − σ ^ u 1 − α 2 , y ^ 0 + σ ^ u 1 − α 2 ] [\hat{y}0 - \hat{\sigma} u{1-\frac{\alpha}{2}}, \hat{y}0 + \hat{\sigma} u{1-\frac{\alpha}{2}}] [y^0−σ^u1−2α,y^0+σ^u1−2α]。

1️⃣1️⃣ 控制问题

控制问题是预测的反问题。若要求 y y y 在某个范围 y 1 ≤ y ≤ y 2 y_1 \le y \le y_2 y1≤y≤y2 内,则变量 x x x 应控制在何处?

即确定 x 1 , x 2 x_1, x_2 x1,x2 使:

{ y ^ ( x 1 ) − δ ( x 1 ) ≥ y 1 y ^ ( x 2 ) + δ ( x 2 ) ≤ y 2 \begin{cases} \hat{y}(x_1) - \delta(x_1) \ge y_1 \\ \hat{y}(x_2) + \delta(x_2) \le y_2 \end{cases} {y^(x1)−δ(x1)≥y1y^(x2)+δ(x2)≤y2

则当 x ∈ [ min { x 1 , x 2 } , max { x 1 , x 2 } ] x \in [\min\{x_1, x_2\}, \max\{x_1, x_2\}] x∈[min{x1,x2},max{x1,x2}] 时,就能以至少 1 − α 1 - \alpha 1−α 的概率保证 x x x 相对应的 y y y 落在区间 [ y 1 , y 2 ] [y_1, y_2] [y1,y2] 内。计算公式:

x 1 = 1 β ^ 1 min ( y 1 − β ^ 0 + σ ^ u 1 − α 2 , y 2 − β ^ 0 − σ ^ u 1 − α 2 ) x 2 = 1 β ^ 1 max ( y 1 − β ^ 0 + σ ^ u 1 − α 2 , y 2 − β ^ 0 − σ ^ u 1 − α 2 ) x_1 = \frac{1}{\hat{\beta}_1} \min(y_1 - \hat{\beta}0 + \hat{\sigma} u{1 - \frac{\alpha}{2}}, y_2 - \hat{\beta}0 - \hat{\sigma} u{1 - \frac{\alpha}{2}}) \\ x_2 = \frac{1}{\hat{\beta}_1} \max(y_1 - \hat{\beta}0 + \hat{\sigma} u{1 - \frac{\alpha}{2}}, y_2 - \hat{\beta}0 - \hat{\sigma} u{1 - \frac{\alpha}{2}}) x1=β^11min(y1−β^0+σ^u1−2α,y2−β^0−σ^u1−2α)x2=β^11max(y1−β^0+σ^u1−2α,y2−β^0−σ^u1−2α)

1️⃣2️⃣ 例题

例2: 为研究商品价格与销售量之间的关系,现在收集了某商品在一个地区 25 个时间段内平均价格 x x x(元)和销售总额 y y y(万元),试研究 y y y 与 x x x 之间的关系。

| x x x | 35.3 | 29.7 | 30.8 | 58.8 | 61.4 | 71.3 | 74.4 | 76.7 | 70.7 |

|---|---|---|---|---|---|---|---|---|---|

| y y y | 10.98 | 11.13 | 12.51 | 8.40 | 9.27 | 8.73 | 6.36 | 8.50 | 7.82 |

| x x x | 46.4 | 28.9 | 28.1 | 39.1 | 46.8 | 48.5 | 59.3 | 70.0 | 70.0 |

| y y y | 8.24 | 12.19 | 11.88 | 9.57 | 10.94 | 9.58 | 10.09 | 8.11 | 6.83 |

| x x x | 72.1 | 58.1 | 44.6 | 33.4 | 28.6 | 57.7 | 74.5 | ||

| y y y | 7.68 | 8.47 | 8.86 | 10.36 | 11.08 | 9.14 | 8.88 |

(1)画散点图

(2) 确定回归方程

由样本数据: x ˉ = 1 25 ∑ i = 1 25 x i = 52.60 , y ˉ = 1 25 ∑ i = 1 25 y i = 9.424 \bar{x} = \frac{1}{25} \sum_{i=1}^{25} x_i = 52.60, \quad \bar{y} = \frac{1}{25} \sum_{i=1}^{25} y_i = 9.424 xˉ=251∑i=125xi=52.60,yˉ=251∑i=125yi=9.424

因而:

β ^ 1 = ∑ i = 1 25 x i y i − 1 25 ( ∑ i = 1 25 x i ) ( ∑ i = 1 25 y i ) ∑ i = 1 25 x i 2 − 25 x ˉ 2 = − 0.0798 β ^ 0 = y ˉ − β ^ 1 x ˉ = 13.623 \hat{\beta}1 = \frac{\sum{i=1}^{25} x_i y_i - \frac{1}{25}(\sum_{i=1}^{25} x_i)(\sum_{i=1}^{25} y_i)}{\sum_{i=1}^{25} x_i^2 - 25\bar{x}^2} = -0.0798 \\ \hat{\beta}_0 = \bar{y} - \hat{\beta}_1 \bar{x} = 13.623 β^1=∑i=125xi2−25xˉ2∑i=125xiyi−251(∑i=125xi)(∑i=125yi)=−0.0798β^0=yˉ−β^1xˉ=13.623所以回归方程为: y ^ = 13.623 − 0.0798 x \hat{y} = 13.623 - 0.0798x y^=13.623−0.0798x

- β ^ 1 = S x y S x x \hat{\beta}1 = \frac{S{xy}}{S_{xx}} β^1=SxxSxy; S x y = ∑ i = 1 n ( x i − x ˉ ) ( y i − y ˉ ) = ∑ i = 1 n x i y i − n x ˉ y ˉ S_{xy} = \sum_{i=1}^{n} (x_i - \bar{x})(y_i - \bar{y}) = \sum_{i=1}^{n} x_i y_i - n\bar{x}\bar{y} Sxy=∑i=1n(xi−xˉ)(yi−yˉ)=∑i=1nxiyi−nxˉyˉ

- S x x = ∑ i = 1 n ( x i − x ˉ ) 2 = ∑ i = 1 n x i 2 − n x ˉ 2 S_{xx} = \sum_{i=1}^{n} (x_i - \bar{x})^2 = \sum_{i=1}^{n} x_i^2 - n\bar{x}^2 Sxx=∑i=1n(xi−xˉ)2=∑i=1nxi2−nxˉ2

(3) 对回归方程进行显著性检验

利用 F 检验法: H 0 : β 1 = 0 , H 1 : β 1 ≠ 0 H_0 : \beta_1 = 0, H_1 : \beta_1 \neq 0 H0:β1=0,H1:β1=0 F = U Q e / ( n − 2 ) ∼ H 0 F ( 1 , n − 2 ) F = \frac{U}{Q_e / (n - 2)} \overset{H_0}{\sim} F(1, n - 2) F=Qe/(n−2)U∼H0F(1,n−2)

已知计算数据: S y y = ∑ i = 1 25 ( y i − y ˉ ) 2 = 63.82 S_{yy} = \sum_{i=1}^{25} (y_i - \bar{y})^2 = 63.82 Syy=∑i=125(yi−yˉ)2=63.82 U = ∑ i = 1 25 ( y ^ i − y ˉ ) 2 = 45.59 U = \sum_{i=1}^{25} (\hat{y}i - \bar{y})^2 = 45.59 U=∑i=125(y^i−yˉ)2=45.59 Q e = ∑ i = 1 25 ( y i − y ^ i ) 2 = 18.82 Q_e = \sum{i=1}^{25} (y_i - \hat{y}i)^2 = 18.82 Qe=∑i=125(yi−y^i)2=18.82检验过程:取 α = 0.05 \alpha = 0.05 α=0.05,查表得 F 0.95 ( 1 , 23 ) = 4.28 F{0.95}(1, 23) = 4.28 F0.95(1,23)=4.28。经计算, f = 57.56 > 4.28 f = 57.56 > 4.28 f=57.56>4.28,所以拒绝 H 0 H_0 H0。

结论:认为回归方程反映了该商品销售总额 y y y 与其价格 x x x 之间的相关关系。

(4) 判定系数计算同样可计算: R 2 = U S y y = 0.714 R^2 = \frac{U}{S_{yy}} = 0.714 R2=SyyU=0.714回归直线的拟合程度较好

(5) 利用回归方程对销售额进行预测点预测

- 当价格 x = x 0 = 28.6 x = x_0 = 28.6 x=x0=28.6 元时,预测销售额 y ^ 0 = 11.34 \hat{y}_0 = 11.34 y^0=11.34 万元。

- 区间预测: 对显著性水平 α = 0.05 \alpha = 0.05 α=0.05,查表得 t 1 − α 2 ( 23 ) = 2.069 t_{1 - \frac{\alpha}{2}}(23) = 2.069 t1−2α(23)=2.069,计算得 δ ( x 0 ) = 1.95 \delta(x_0) = 1.95 δ(x0)=1.95

- 所以 y 0 y_0 y0 置信水平为 95% 的预测区间为: [ y ^ 0 − δ ( x 0 ) , y ^ 0 + δ ( x 0 ) ] = [ 9.39 , 13.29 ] [\hat{y}_0 - \delta(x_0), \hat{y}_0 + \delta(x_0)] = [9.39, 13.29] [y^0−δ(x0),y^0+δ(x0)]=[9.39,13.29],即把价格定在 28.6元时,销售总额落在区间 [9.39, 13.29] 的概率为 95%。

(6) 回归控制

若要使销售额 y y y 控制在 [10, 12] 之间,则根据回归方程: { 10 = 13.623 − 0.0798 x 1 12 = 13.623 − 0.0798 x 2 \begin{cases} 10 = 13.623 - 0.0798x_1 \\ 12 = 13.623 - 0.0798x_2 \end{cases} {10=13.623−0.0798x112=13.623−0.0798x2

解得价格 x x x 的控制范围为 [20.34, 45.40]。

例 4.4 已经知道加入某种催化剂可以降低汽车在燃烧汽油时排出废气中氧化氮的含量。现在试验加入不同量的催化剂(这是可严格控制的变量,作为自变量 x x x),测量废气中氧化氮的降低量(这个降低量受种种因素的影响,作为因变量 y y y),结果如下表所示:

| 催化剂量 ( x x x) | 1 | 1 | 2 | 3 | 4 | 4 | 5 | 6 | 6 | 7 |

|---|---|---|---|---|---|---|---|---|---|---|

| 氧化氮降低量 ( y y y) | 2.1 | 2.5 | 3.1 | 3.0 | 3.8 | 3.2 | 4.3 | 3.9 | 4.4 | 4.8 |

bash

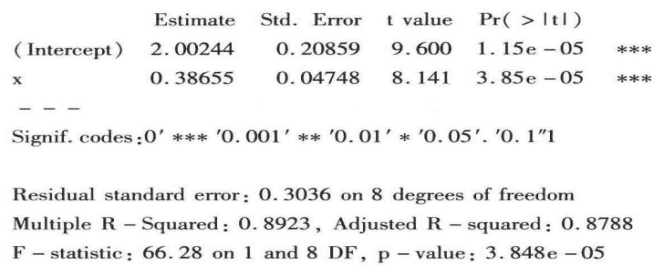

> summary( lm( y ~ x ) )

call:

lm( formula = y ~ x )