最近这一两周看到不少互联网公司都已经开始秋招提前批了。

不同以往的是,当前职场环境已不再是那个双向奔赴时代了。求职者在变多,HC 在变少,岗位要求还更高了。

最近,我们又陆续整理了很多大厂的面试题,帮助一些球友解惑答疑,分享技术面试中的那些弯弯绕绕。

合集:

喜欢本文记得收藏、关注、点赞。更多实战和面试交流,文末加入我们

分享我们一星球成员最新面经:

个人情况

985 本硕+项目一个+论文一篇+无实习经历

时间节点

-

7.2 技术面一面

-

7.4 技术面二面

-

7.9 HR 面

-

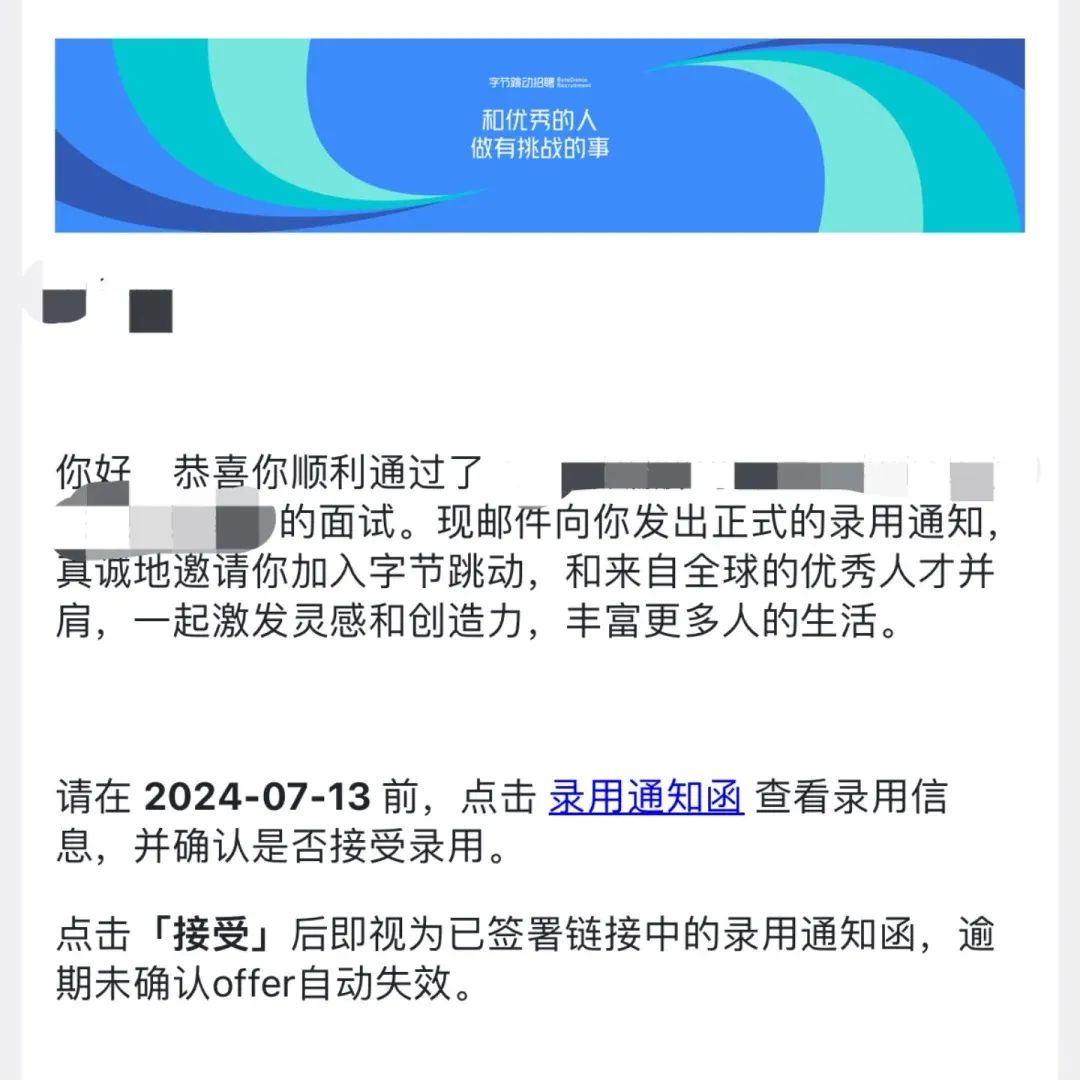

7.12 offer call+发offer

面经总结

技术面试

主要问简历项目内容和专业相关知识,也有业务场景提出方案与策略。

在回答业务场景并设计方案的时候,确实之前没有遇到过,所以感觉自己也答的磕磕绊绊,比较好的是,面试官最开始会详细讲解具体是什么场景。

HR 面

想在实习中学到什么/如果offer不过你会做什么/到岗时间和时长/在做项目的过程中遇到的困难/有无考博打算

15分钟很快结束,我还以为凉了,后来发现好像基本都是这个时间。

总结一下:

字节的面试流程很规范,每次都会hr提前联系约面。流程进度也很快,从面试到offer时间为10天。

6、7月份实习还是要试着捡漏的(虽然我简历是5月份投的)

希望大家都能心想事成~

高频面试题总结

-

目前主流的开源模型体系有哪些?

-

你了解ReAct吗,它有什么优点?

-

解释一下langchain Agent的概念

-

langchain 有哪些替代方案?

-

LLM 预训练阶段有哪几个关键步骤?

-

RLHF 模型为什么会表现比SFT更好?

-

参数高效的微调(PEFT)有哪些方法?

-

LORA 微调相比于微调适配器或前缀微调有什么优势?

-

请简述TPPO算法流程,它跟TRPO的区别是什么?

-

目前主流的中文向量模型有哪些?

-

为什么LLM的知识更新很困难?

-

RAG和微调的区别是什么?

-

大模型一般评测方法及其准是什么?

-

什么是Kv cache技术,它具体是如何实现的?

-

DeepSpeed推理对算子融合做了哪些优化?

-

简述一下FlashAttention的原理

-

MHA、GQA、MQA三种注意力机制的区别是什么?

-

请介绍一下微软的ZeRO优化器

-

Paged Attention的原理是什么,解决了LLM中的什么问题?

-

什么是投机采样技术,请举例说明?

-

简述GPT和BERT的区别

-

讲一下GPT系列模型的是如何演进的?

-

为什么现在的大模型大多是decoder-only的架构?

-

讲一下生成式语言模型的工作机理

-

哪些因素会导致LLM中的偏见?

-

LLM中的因果语言建模与掩码语言建模有什么区别?

-

如何减轻LLM中的"幻觉"现象?

-

解释ChatGPT的"零样本"和"少样本"学习的概念

-

你了解大型语言模型中的哪些分词技术?

-

如何评估大语言模型(LLMs)的性能?

-

请简述下 Transformer 基本原理

-

为什么 Transformer 的架构需要多头注意力机制?

-

为什么transformers需要位置编码?

-

transformer中,同一个词可以有不同的注意力权重吗?

-

Wordpiece与BPE之间的区别是什么?

-

有哪些常见的优化LLMs输出的技术?

-

为什么transformer块使用LayerNorm而不是BatchNorm?

-

介绍一下post layer norm和pre layer norm的区别

-

prefix LM和causal LM区别是什么?

-

llama输入句子长度理论上可以无限长吗?

-

如何让大模型处理更长的文本?

-

为什么大模型推理时显存涨的那么多还一直占着?

-

有哪些省内存的大语言模型训练/微调/推理方法?

-

RLHF在实践过程中存在哪些不足?

-

如何解决三个阶段的训练(SFT->RM->PPO)过程较长,更新迭代较慢问题?

-

什么是位置编码?

-

什么是绝对位置编码?

-

什么是相对位置编码?

-

旋转位置编码RoPE思路是什么?

-

旋转位置编码RoPE有什么优点?

-

Layer Norm 的计算公式写一下?

-

RMS Norm 的计算公式写一下?

-

RMS Norm 相比于 Layer Norm 有什么特点?

-

Deep Norm 思路?

-

写一下 Deep Norm 代码实现?

-

Deep Norm 有什么优点?

-

LN在LLMs中的不同位置有什么区别么?如果有,能介绍一下区别么?

-

RMS Norm 相比于 Layer Norm 有什么特点?

-

Deep Norm 思路?

-

写一下 Deep Norm 代码实现?

-

Deep Norm 有什么优点?

-

LN在LLMs中的不同位置有什么区别么?如果有,能介绍一下区别么?

-

LLMs各模型分别用了哪种Layer normalization?

技术交流&资料

技术要学会分享、交流,不建议闭门造车。一个人可以走的很快、一堆人可以走的更远。

成立了算法面试和技术交流群,相关资料、技术交流&答疑,均可加我们的交流群获取,群友已超过2000人,添加时最好的备注方式为:来源+兴趣方向,方便找到志同道合的朋友。

方式①、微信搜索公众号:机器学习社区,后台回复:加群

方式②、添加微信号:mlc2040,备注:来自CSDN + 技术交流

精选

- 轻松构建聊天机器人,大模型 RAG 有了更强大的AI检索器

- 一文搞懂大模型训练加速框架 DeepSpeed 的使用方法!

- 保姆级学习指南:《Pytorch 实战宝典》来了

- MoE 大模型的前世今生

- 从零解读 SAM(Segment Anything Model)

- AI 绘画爆火背后:扩散模型原理及实现

- 从零开始构建和训练生成对抗网络(GAN)模型

- CLIP/LLaVA/LLaVA1.5/VILA 模型全面梳理!

- 从零开始创建一个小规模的稳定扩散模型!

- Stable Diffusion 模型:LDM、SD 1.0, 1.5, 2.0、SDXL、SDXL-Turbo 等

- 文生图模型:AE、VAE、VQ-VAE、VQ-GAN、DALL-E 等 8 模型

- 一文搞懂 BERT(基于Transformer的双向编码器)

- 一文搞懂 GPT(Generative Pre-trained Transformer)

- 一文搞懂 ViT(Vision Transformer)

- 一文搞懂 Transformer

- 一文搞懂 Attention(注意力)机制

- 一文搞懂 Self-Attention 和 Multi-Head Attention

- 一文搞懂 Embedding(嵌入)

- 一文搞懂 Encoder-Decoder(编码器-解码器)