这是我在我的网站中截取的文章,有更多的文章欢迎来访问我自己的博客网站rn.berlinlian.cn,这里还有很多有关计算机的知识,欢迎进行留言或者来我的网站进行留言!!!

一、决策树模型:分类示例

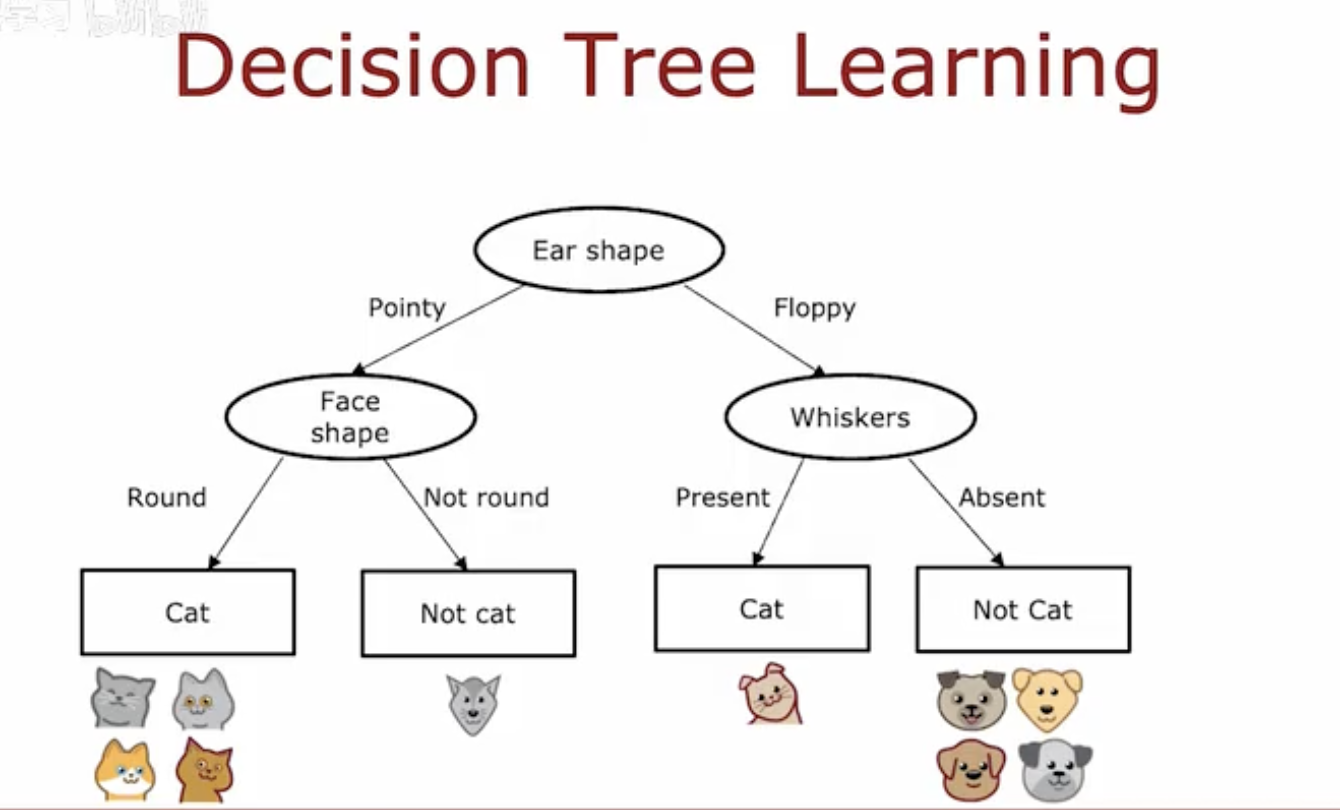

这幅图片展示了一个决策树模型,用于区分动物是否为猫。在这个例子中,决策树使用耳朵形状、面部形状和胡须的存在与否来确定一个动物是否是猫。

以下是决策树的详细解释:

-

根节点(Root Node):

- 决策树的顶部是根节点,这里表示的是"耳朵形状"(Ear shape)。

-

第一层分支(First Level of Branches):

-

从根节点出发,有两个分支:

-

如果耳朵是"尖的"(Pointy),则进入左侧的分支。

-

如果耳朵是"垂的"(Floppy),则进入右侧的分支。

-

-

-

第二层节点(Second Level Nodes):

-

左侧分支指向"面部形状"(Face shape):

-

如果面部形状是"圆的"(Round),则该动物是猫。

-

如果面部形状不是圆的,则该动物不是猫。

-

-

右侧分支指向"胡须"(Whiskers):

-

如果胡须"存在"(Present),则该动物是猫。

-

如果胡须"不存在"(Absent),则该动物不是猫。

-

-

-

叶节点(Leaf Nodes):

-

决策树的底部是叶节点,表示最终的分类结果:

-

左侧有两个叶节点,分别表示"猫"(Cat)和"不是猫"(Not cat)。

-

右侧也有两个叶节点,同样表示"猫"(Cat)和"不是猫"(Not cat)。

-

-

-

示例动物:

-

图片底部展示了一些动物的图标,这些图标用来说明决策树的分类结果:

-

左侧的图标是猫,它们符合"尖耳朵"和"圆脸"的条件。

-

右侧的图标不是猫,它们可能是其他动物,如狗或狼,它们不符合猫的特征。

-

-

这个决策树模型通过简单的特征(耳朵形状、面部形状和胡须)来进行分类,展示了决策树如何通过一系列的决策规则来预测结果。

二、决策树模型的关键决策

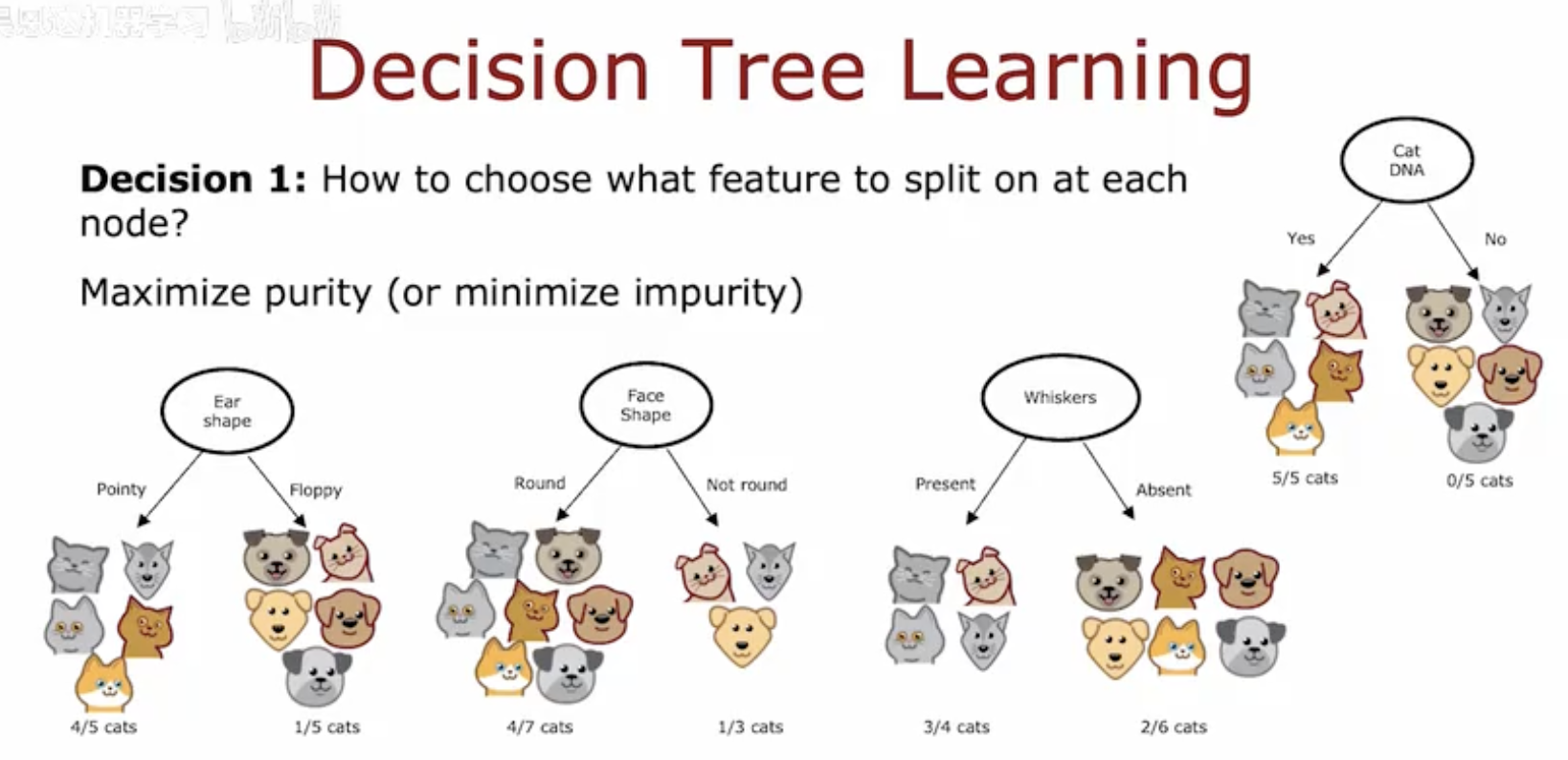

1. 决策树学习中的特征选择:选择最佳分割特征

-

决策树通过在每个节点上选择一个特征进行分割来构建。选择特征的目标是最大化节点的纯度(或最小化不纯度)。

-

图片展示了一个决策树的示例,用于分类猫和非猫。树的每个节点根据耳朵形状、面部形状和胡须的存在与否进行分割。

-

每个节点下方展示了该节点包含的猫和非猫的数量,以及猫的比例。例如,耳朵形状为"Pointy"的节点中有4只猫和1只非猫,猫的比例为4/5。

-

通过比较不同特征分割后的纯度,算法选择能够最大化纯度的特征进行分割。在这个例子中,"Cat DNA"特征提供了最高的纯度,因为它完全区分了猫和非猫。

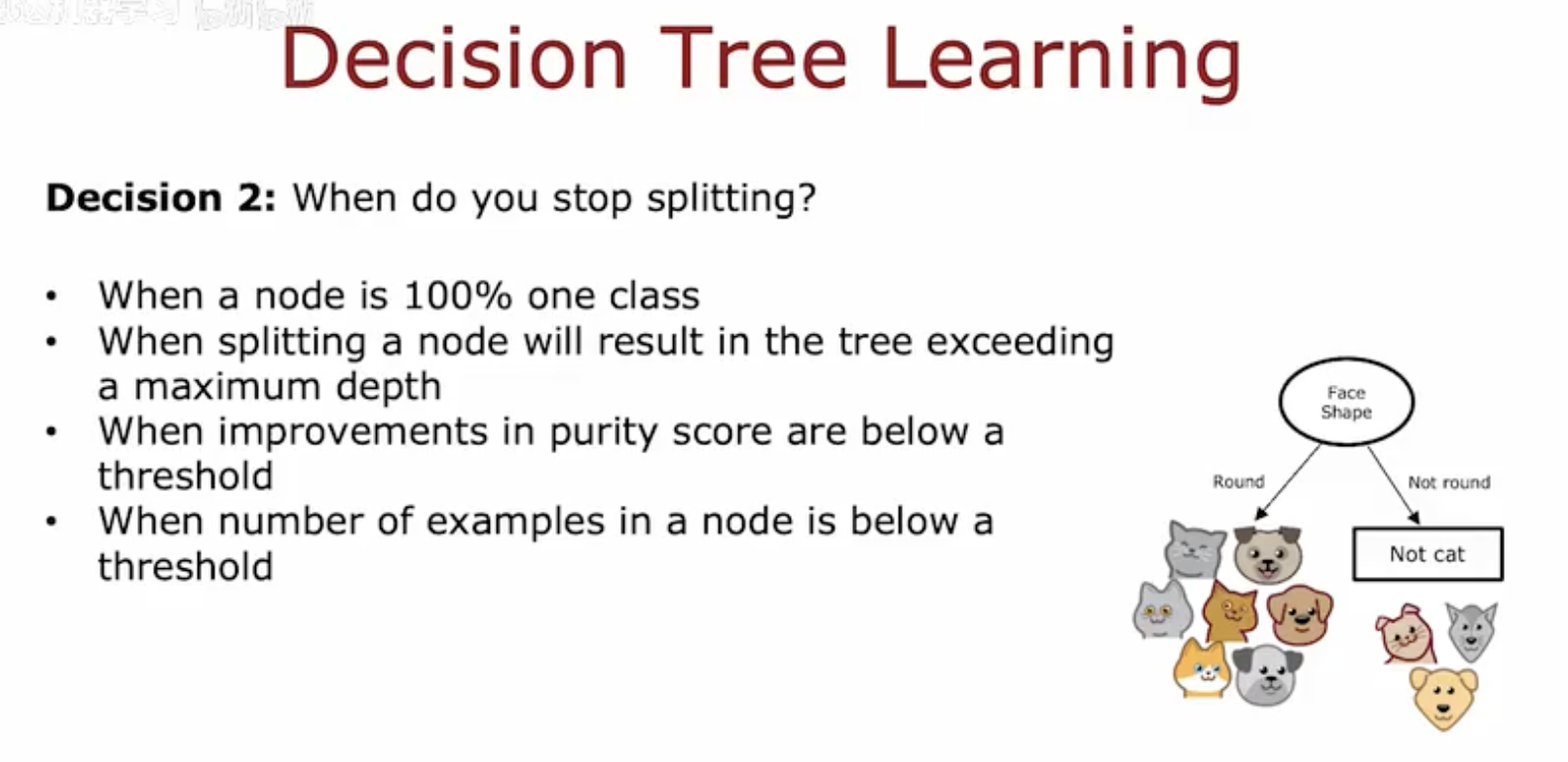

2. 决策树学习中的停止条:决定何时停止分割

-

决策树学习过程中的另一个关键决策是何时停止对节点进行分割。这是为了避免过拟合,即模型在训练数据上表现很好,但在新数据上表现不佳。

-

图片列出了四个停止分割的条件:

-

当一个节点是100%一个类别时,这个节点是纯净的,不需要进一步分割。

-

当分割一个节点会导致树超过最大深度时,停止分割以防止树变得过于复杂。

-

当纯度分数的改进低于一个阈值时,停止分割,因为进一步分割带来的改进很小。

-

当节点中的样本数量低于一个阈值时,停止分割,因为样本太少可能导致过拟合。

-

-

图片右侧展示了一个简化的决策树示例,说明了如何根据面部形状进行分割。这个示例展示了如何根据停止条件来决定是否继续分割节点。

通过这两个关键决策,决策树学习算法能够有效地构建模型,同时避免过拟合,提高模型的泛化能力。

这是我在我的网站中截取的文章,有更多的文章欢迎来访问我自己的博客网站rn.berlinlian.cn,这里还有很多有关计算机的知识,欢迎进行留言或者来我的网站进行留言!!!