当前,人形机器人在交互智能与运动智能领域已经取得了显著进展,这既得益于AI大模型与深度学习技术的驱动,也离不开其在视觉、听觉及本体运动感知方面的能力提升。

然而,当任务场景从宏观运动控制延伸到精细的末端操作时,我们便遭遇了关键瓶颈。这一瓶颈的核心,在于机器人感知体系中有一个至关重要的缺失------触觉感知。

具体而言,尽管现有的视觉系统能精准识别物体的外观与空间位置,但它对操作过程中至关重要的力、振动、纹理、温度等物理属性却是"盲区";而本体感知主要监测关节内部的电机状态(如角度、扭矩),无法直接捕捉末端执行器(如手指)与环境之间微观的相互作用力与接触状态。

触觉的缺席,使得机器人的操作行为在临界的接触瞬间失去了关键的反馈闭环,导致机器人难以精准、灵活且安全地完成复杂操作。

触觉感知的引入,不仅仅是扩展了机器人的感知维度,更使其能够真正"理解"物体特性与环境状态,包括软硬程度、表面纹理、实时受力分布,乃至微小的滑动趋势。这将有助于机器人在非结构化抓取、灵巧操作等复杂任务中,实现从"看得见"到"抓得稳、控得精"的跨越,从而大幅提升机器人在上肢操作方面的智能化水平。

一、视触觉传感器基础介绍

当前,基于传统方案的触觉传感器在机器人应用中仍存在一些问题,例如**++感知模态有限、精度与分辨率不足、系统可扩展性较弱,难以支撑机器人在复杂场景下的高操作任务要求。++**

与之相比,视触觉传感器以通过摄像头捕捉并表征接触过程中的弹性体形变,将触觉信息转换为高分辨率的视觉信号,从而能够实现对力、纹理、温度乃至物体姿态等多模态触觉信息的高精度感知。

1. 工作原理

视触觉传感器(Vision-Based Tactile Sensor,VBTS)是一种基于光学成像原理的触觉感知装置。其核心工作原理为:通过内置摄像头实时捕捉弹性接触表面在与物体交互时产生的微观形变,进而将这些形变信息转换为高分辨率的视觉信号,实现对多种触觉属性的精确测量。

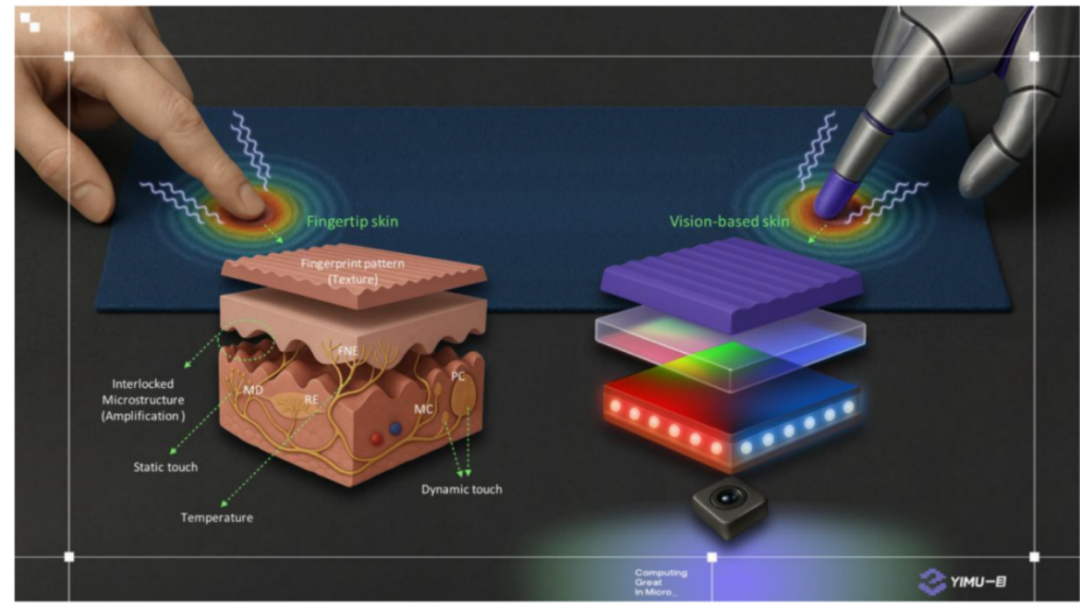

人手触觉感知VS视触觉Sensor感知(图片来源:一目科技)

与传统单一维度的力传感器相比,视触觉传感器能够同步感知多维信息,包括:法向力与剪切力、物体表面的纹理特征、接触区域的相对滑动趋势等。该技术复现了接近人手的多维度触觉感知能力,为机器人灵巧操作提供了关键的传感基础。

2. 视触觉系统构成

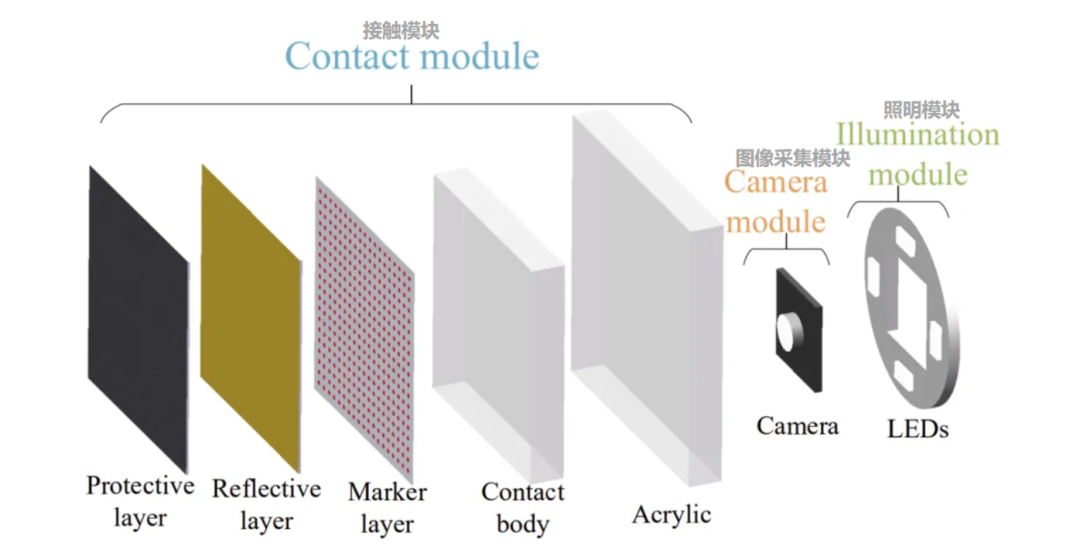

视触觉传感系统的典型结构通常由接触模块、照明模块、图像采集模块 和信息处理模块组成。四大模块按"物理接触→光线辅助→图像捕捉→数据解析" 的闭环协同,实现对物体物理属性与交互力的精准感知。

视触觉传感器的结构组成

(图片来源:论文- Hardware Technology of Vision-Based Tactile Sensor: A Review )

备注: 信息处理模块通常独立于传感器,单独布置。

1) ****接触模块:****物理交互的"感知前端"。主体为柔性透光材料(如硅胶、水凝胶、弹性聚合物),内部嵌入微米级标记点。物体接触时产生弹性形变,通过内部标记点的位置偏移、形状变化,将物理接触信号(压力、剪切力、滑移)转化为可观测的结构变化。

****2)照明模块:****成像清晰的"光线保障"。以 LED 阵列(近红外光或可见光)为主,部分高端产品采用光纤光源或面光源。照亮接触模块内部的标记点,提升图像对比度,消除环境光干扰,为图像采集模块提供清晰的成像基础。LED光源有三种常见分布方式:垂直照明、侧照明和接触体/亚克力的全内反射。全内反射可以在狭小空间内实现均匀光照。

3) ****图像采集模块:****视觉信号的"捕捉核心"。核心部件是摄像头(通常是CMOS传感器)。实时拍摄接触模块的动态形变图像,记录标记点的位置、形状变化,将物理形变转化为可计算的数字图像数据。事件相机、双目 / 多相机系统及红外相机等,则为特殊场景需求提供专属解决方案。

****4)信息处理模块:****触觉数据的"解析中枢"。系统装置的"大脑",利用算法从图像序列中解析出触觉信息。

二、视触觉传感器特点分析

视触觉传感器的核心技术路径是将光学成像与深度学习模型相结合。它通过摄像头捕获接触引发的形变,再依赖算法模型建立从视觉序列到触觉物理量(如力、滑动)的映射。

这一模式高度依赖于高质量的标注数据和强大的模型训练,因此前期数据采集与训练成本较高。然而,由于它的感知基础是高分辨率的图像信息,其理论性能上限远高于传统基于离散电子元件的触觉传感器,能够揭示更丰富的接触物理现象。

视触觉传感器不仅突破了传统触觉感知在精度与模态上的技术瓶颈,更以其图像化、高兼容的数据形式,为机器人灵巧操作和跨模态学习的实现提供了关键感知基础,被视为推动机器人进入真实复杂场景应用的关键组件。

具体来讲, 视触觉传感器具有以下优势 :

****1)高分辨率:****提供高空间分辨率的触觉信息,而非离散点的采样数据。这使得它能够捕捉微米级的表面纹理与几何特征,实现更加精细的触觉感知。

2) ****多模态信息:****可从单次接触的形变图像中,同步解析出法向/剪切力、压力分布、表面纹理、滑动趋势等多种物理信息,提供更为全面的触觉信息。

3) ****系统集成简化:****其核心感知元件为摄像头,避免了在触觉传感器中密集排布大量电子元件所带来的复杂布线与封装挑战。

4) 抗干扰性 ****强:****由于采用光学信号采集方式,视触觉传感器对环境中的电磁干扰、温湿度波动具有天然的抵抗能力,稳定性更高。

5) ****与视觉AI的天然协同:****其输出为标准的图像格式,与主流的计算机视觉算法及AI大模型(如深度学习网络)能够更好地进行兼容。

然而,++视触觉传感器是一项++ ++"天花板"很高但"地板"也很高的技术++------其理论潜能巨大,但需要同时在硬件设计(材料、集成)、算法创新(效率、泛化)和算力支撑等多个前沿阵地取得突破,才能将其潜力转化为在复杂场景下稳定、可靠的机器人感知能力。

例如,有相关业内专家曾提到视触觉传感器在机器人领域应用仍面临着一些关键挑战。

****1)还难以在复杂曲面上实现大范围集成与无缝感知。****基于相机的成像系统需要特定的光路厚度和视角(FOV),这导致传感器难以在保持高性能的同时,被微型化并紧密排布于指尖、指腹、掌部等具有复杂曲率的表面上。

2)难以弥补传感器物理极限与系统控制需求之间的差距。灵活性瓶颈------ 为了产生足够光学相机捕捉的形变,需要一定的压强(例如硅胶产生可被观测的形变压强在1kPa以上)。这导致其对微细力和纳米级位移的响应不敏感;实时性瓶颈 ------ 高帧率、高分辨率的图像流处理,叠加复杂的3D重建与力解算过程,造成了显著的信号延迟,这使得系统响应频率难以满足高速、高动态操作的实时控制要求。