本推文对2025年9月计算机视觉顶级期刊《IEEE Transactions on Image Processing》(简称TIP)的研究热点进行了分析,对收录的60篇论文进行了标题高频词统计,深入挖掘了计算机视觉领域的当前研究动态。希望本文能为计算机视觉领域的研究人员提供一些有价值的参考。

本推文由龚裕涛撰写,审校为王一鸣、黄忠祥。

1 期刊简介

IEEE Transactions on Image Processing是计算机视觉和图像处理领域的顶级期刊。期刊主题涵盖图像、视频及多维信号在广泛应用场景中的生成、采集、处理、通信、分析与显示的新理论、算法及体系结构,重点议题包括(但不限于)图像、视频及多维信号的数学/统计/感知建模、表示、生成、编码、滤波、增强、复原、渲染、半调处理、检索与分析。期刊主要应用领域涉及图像视频通信、电子成像、生物医学成像、图像视频系统及遥感技术。

期刊链接 :http://ieeexplore.ieee.org/xpl/RecentIssue.jsp?punumber=83

表1 TIP近年指标数据

|------|-----|---------|

| 年度 | 发文量 | 影响因子 |

| 2019 | 446 | 9.3406 |

| 2020 | 722 | 10.8555 |

| 2021 | 703 | 11.0404 |

| 2022 | 546 | 10.6002 |

| 2023 | 480 | 10.7997 |

| 2024 | 495 | 13.7000 |

2 热点分析

本文对《IEEE Transactions on Image Processing》2025年9月发布的论文进行了分析。

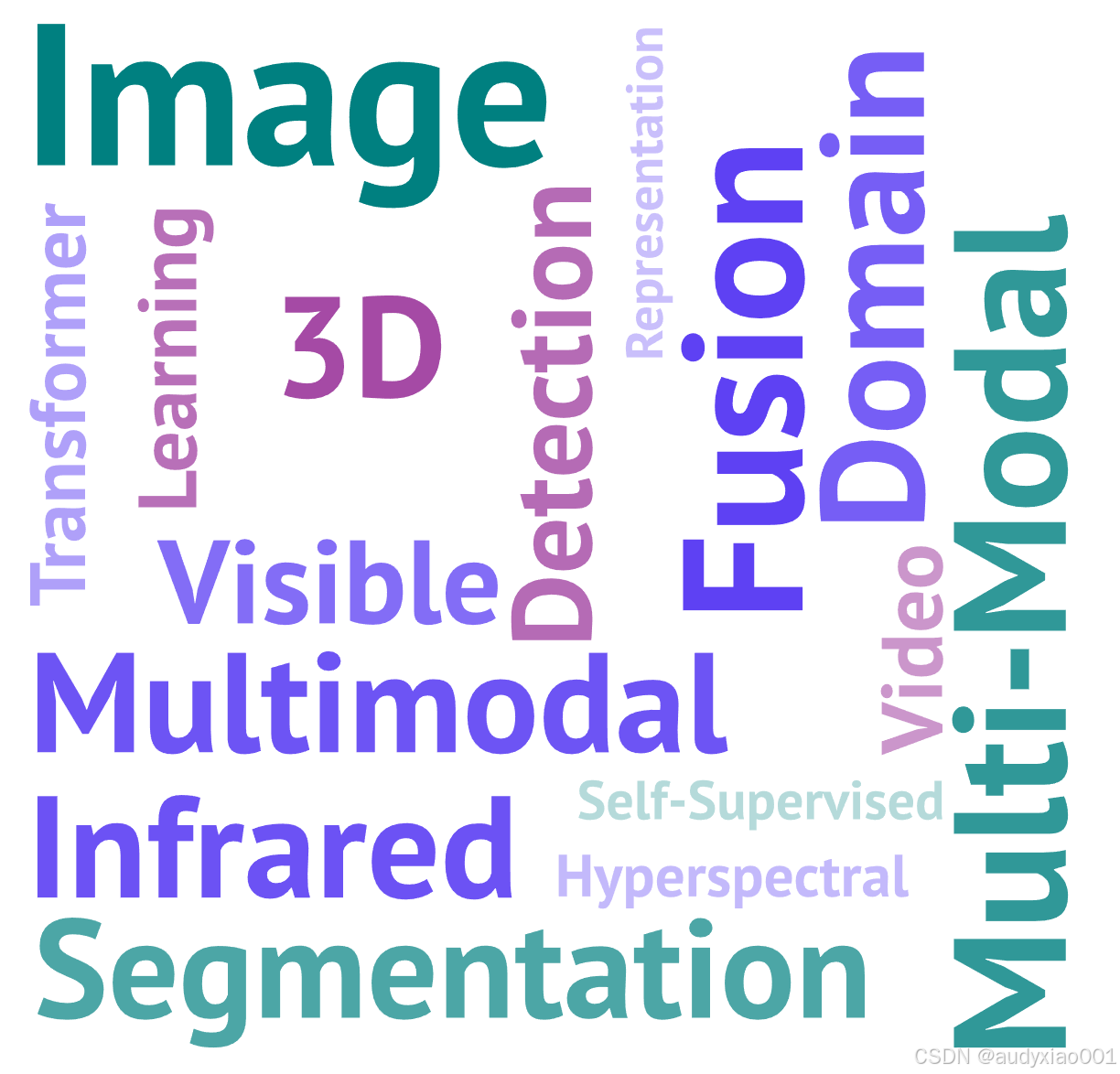

图1 根据高频词绘制的词云图

图1展示的是基于23篇论文的标题生成的关键词词云图,直观地反映了研究热点的分布,旨在为图像处理领域的研究人员提供跟踪热点与研究方向参考。

表2对于9月刊收录论文的题目高频词进行了统计。从高频词统计结果可以看出,"Image(图像)"以38次的出现频率位居首位,表明图像相关任务仍是当前计算机视觉与图像处理领域的核心研究载体,其在图像融合、分割、超分辨率、质量评估等多元化任务中发挥着基础支撑作用。"Multi-Modal/(多模态)"出现10次,反映了多模态技术在跨数据类型协同建模中的重要性,尤其是多模态融合与知识迁移,正成为突破单模态局限的关键方向。

"Segmentation(分割)"以8次的出现频率紧随其后,可见分割任务仍是领域内的重点研究方向,医学图像分割、伪装目标分割、3D医学图像分割等细分场景,凭借其在临床诊断、目标检测等领域的实用价值,持续吸引大量研究关注。"Fusion(融合)"和"Domain(域)"各出现7次,显示出当前研究对数据协同利用与模型泛化能力的双重重视,融合技术通过整合不同模态或维度的图像信息提升表征完整性,而域相关研究(如无源域自适应、跨域学习)则聚焦解决模型在不同数据分布场景下的适配问题。

"Detection(检测)"和"Learning(学习)"各出现6次,体现了目标检测任务的持续热度与学习方法的基础性地位。检测任务涵盖伪装目标、场景文本、通用目标等多个细分方向,学习方法则在提示学习、协同学习、自监督学习等领域不断创新,为各类任务提供技术支撑。"Visible(可见光)"和"Infrared(红外)"各出现5次,反映出红外,可见光跨模态任务,如图像融合、对齐已成为特定场景,如军事侦察、夜间监测下的重要研究分支,两类数据的互补性使其在复杂环境感知中具有不可替代的价值。

"Hyperspectral(高光谱)""Transformer(Transformer)""3D(三维)"各出现4次,展现了领域对特殊图像类型处理、新型模型架构应用与三维视觉的高度关注。高光谱技术在变化检测、纹理测量中凸显优势,Transformer凭借全局建模能力革新分割、超分辨率等任务,3D技术则在医学影像分割、人体姿态估计、面部吸引力计算中开辟新方向。"Video(视频)""Representation(表示)""Self-Supervised(自监督)"各出现3次,反映出研究从静态图像向动态视频延伸、对特征表示质量的持续优化,以及对数据效率提升的探索,视频重着色、压缩、检索任务拓展了技术应用维度,高质量特征表示是模型性能的核心保障,自监督学习则通过无标注数据挖掘降低对标注成本的依赖。

表2 论文标题高频词

|-------------|------|

| 关键词 | 出现次数 |

| 图像 | 38 |

| 多模态 | 10 |

| 分割 | 8 |

| 融合 | 7 |

| 域 | 7 |

| 检测 | 6 |

| 学习 | 6 |

| 可见光 | 5 |

| 红外图像 | 5 |

| 高光谱 | 4 |

| Transformer | 4 |

| 三维 | 4 |

| 视频 | 3 |

| 自监督 | 3 |

3 总结

通过对60篇TIP期刊论文的深入分析,我们可以清晰看到计算机视觉与图像处理领域的技术主线和关键突破,这些成果集中体现在近期发表的重要论文中:

(1)多模态技术实现跨数据类型协同突破多模态融合方向有三项代表性成果:《CLIP-Based Multi-Modal Feature Learning for Cloth-Changing Person Re-Identification》借助 CLIP 模型的跨模态能力,解决了服装变化场景下的行人重识别难题,在公开数据集上提升了识别鲁棒性。《Image-Text-Image Knowledge Transfer for Lifelong Person Re-Identification With Hybrid Clothing States》创新提出图像-文本-图像的知识迁移框架,为终身学习场景下的跨模态行人重识别提供新方案。《MSP Multimodal Self-Attention Prompt Learning》通过多模态自注意力提示学习,强化了不同数据类型间的特征关联,在多标签图像分类任务中表现优异。

(2)图像分割与融合技术向细分场景深化分割与融合领域成果显著:《FocalTransNet A Hybrid Focal-Enhanced Transformer Network for Medical Image Segmentation》设计混合聚焦增强Transformer架构,精准捕捉医学图像中的细微病灶区域。《UMCFuse A Unified Multiple Complex Scenes Infrared and Visible Image Fusion Framework》构建统一融合框架,解决了复杂场景下红外与可见光图像特征错位问题,提升了夜间监测场景的图像质量。《MambaDiff Mamba-Enhanced Diffusion Model for 3D Medical Image Segmentation》将 Mamba 模型与扩散模型结合,实现3D医学影像的高精度分割,降低了小病灶漏检率。

(3)跨域与高效计算技术推动落地应用实用化技术方向有重要进展:《Consistent Assistant Domains Transformer for Source-Free Domain Adaptation》提出一致性辅助域Transformer,在无目标域标注的情况下,实现了模型跨域自适应,为工业质检等数据稀缺场景提供解决方案。《NanoHTNet Nano Human Topology Network for Efficient 3D Human Pose Estimation》设计轻量化人体拓扑网络,在保证3D姿态估计精度的同时,将模型参数压缩,满足边缘设备实时计算需求。《Instance-Adaptive Spatial-Temporal Enhancement for Efficient Video Compression》通过实例自适应时空增强,在同等压缩率下提升视频画质,推动高效视频传输技术落地。

总的来说,当前TIP期刊研究呈现出"以图像为核心、多技术协同、向实用场景深化"的特点,图像载体、多模态技术、分割与融合任务构成三大研究支柱。研究热点既包括基础的模型架构优化,如Transformer、自监督学习,也涵盖前沿的跨模态协同,如多模态融合与三维建模。随着技术的不断迭代,领域研究正朝着更复杂场景适配、更高性能输出、更广泛应用落地的方向迈进,展现出强劲的技术创新活力与广阔的产业应用前景。