目录

[1 嵌入矩阵的转置作为线性层参数的问题](#1 嵌入矩阵的转置作为线性层参数的问题)

[2 实际使用时的注意事项](#2 实际使用时的注意事项)

abstract:

Transformer中嵌入矩阵的转置作为线性层参数

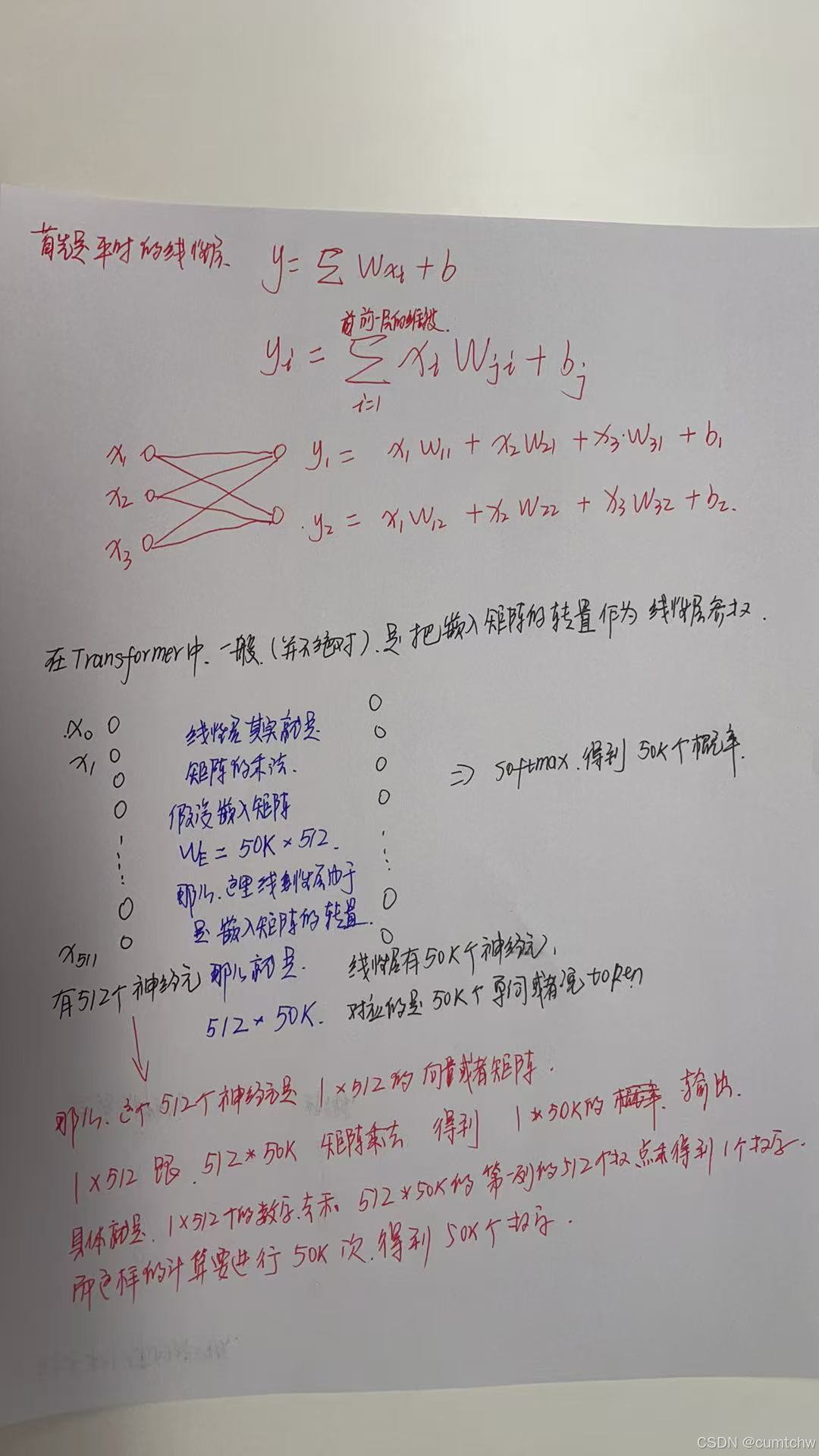

1 嵌入矩阵的转置作为线性层参数的问题

在看transformer的学习视频时,我看视频里面说了个反嵌入层,然后去查了下,结果发现竟然这个反嵌入层就是作为线性层的,于是理解了一下,然后了下面的笔记。

2 实际使用时的注意事项

-

在原始Transformer论文中,嵌入权重乘以dmodel,输出层使用相同的缩放

-

并非所有Transformer变体都严格遵循这一设计(如某些模型使用独立的输出投影层)

-

在实现中有时会添加额外的偏置项