就在刚刚,Ultralytics 正式发布 YOLO26,这是迄今为止最先进、最易部署的 YOLO 模型。就是那个在 YOLO Vision 2025 大会上首次亮相的新一代视觉模型。不得不说,每次 YOLO 更新都像在技术圈扔下一颗深水炸弹,而 YOLO26 这次带来的不仅是性能的提升。

今天咱们来聊聊从"实验室利器"到"落地实战派"的彻底转身!

随着视觉 AI 迅速向边缘端迁移,图像与视频越来越多直接在设备、摄像头、机器人和嵌入式系统上处理。大家对模型的期待早已不只是"刷高指标",而是实打实的低延迟、高稳定、易部署。

YOLO26 正是为这一现实量身打造,能在 CPU、边缘加速器和低功耗硬件上高效运行,同时提供业界领先的性能。那么下面就让我更加详细地看看YOLO 26有什么不一样呢?

从"技术高地"到"人人可用"

在伦敦举办的 YV25 大会上,Ultralytics 创始人兼首席执行官 Glenn Jocher 阐述了 YOLO26 的核心理念:"最顶尖的 AI 技术往往被束之高阁,并未对外开放。Ultralytics 选择了一条不同的道路,我们希望 AI 能真正掌握在每个人手中。"

意味着你不再需要庞大的服务器集群,也能在摄像头、手机、嵌入式设备上跑起一流的视觉模型。 让致力于解决实际问题的开发者也能获得顶尖技术支持。

YOLO26 设计初衷即为 视觉 AI 的实际部署场景而生,而非仅停留在原型验证阶段。

"统一架构+全任务",把落地效率拉满

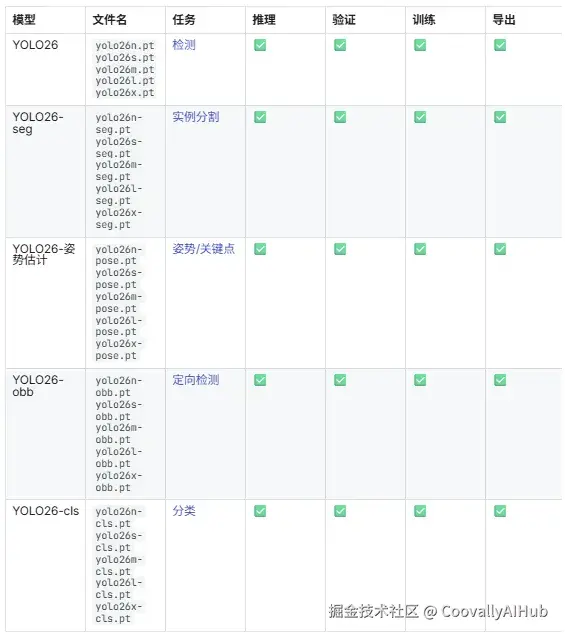

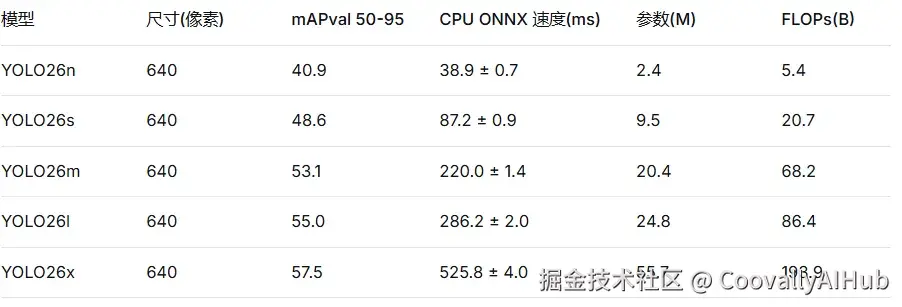

与以往的 Ultralytics YOLO 系列一致,YOLO26 采用统一模型家族设计,提供五种尺寸:Nano(n)、Small(s)、Medium(m)、Large(l)和 Extra Large(x)。

团队可根据部署环境,在速度、精度和模型体量间灵活取舍。

YOLO26 全面支持多种计算机视觉任务:

- 图像分类: 对整图进行场景语义理解

- 目标检测: 在图像或视频中定位识别多个目标

- 实例分割: 以像素级精度勾勒物体轮廓

- 姿态估计: 识别关键点并估计人体或其他对象姿态

- 旋转框(OBB)检测: 支持不同角度目标检测,适用于航拍和卫星影像

- 目标跟踪: 在视频流中持续跟踪目标

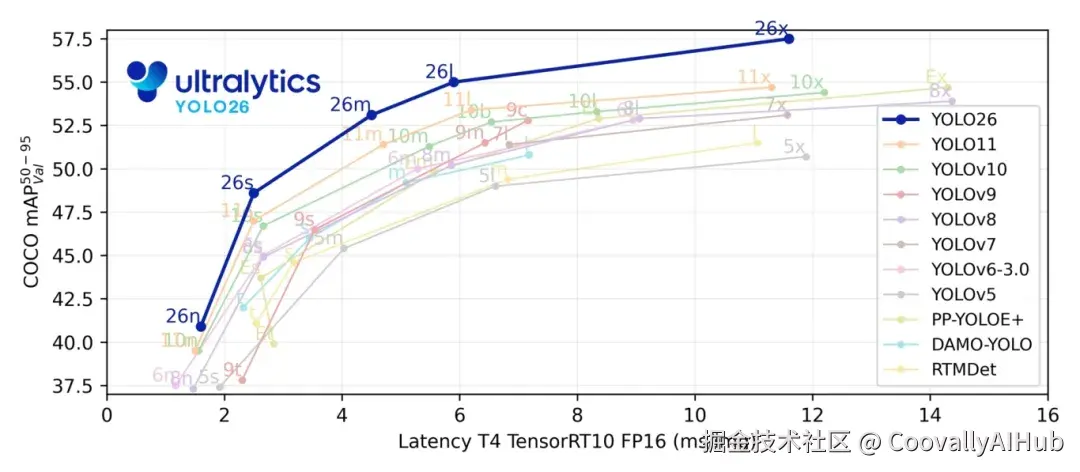

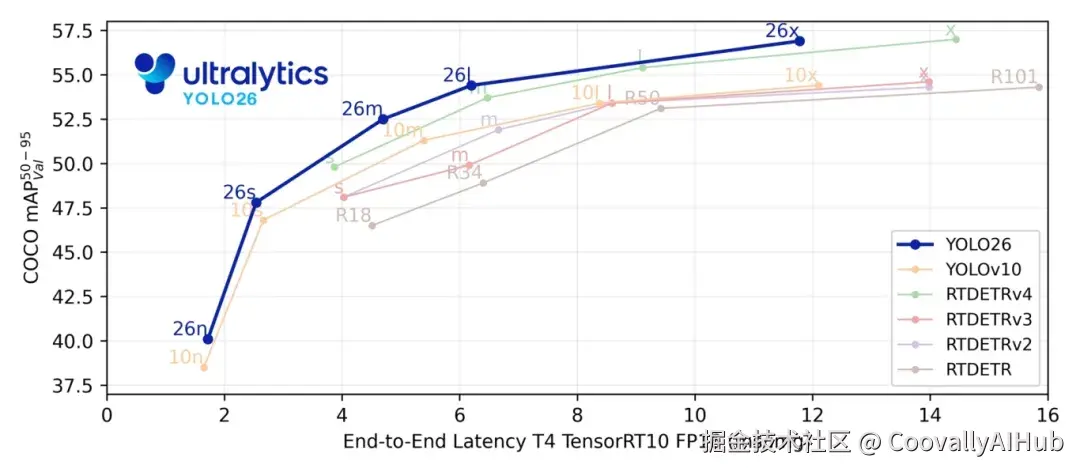

性能方面,YOLO26 大幅提升性能上限。与 YOLO11 相比,其 Nano 版本在 CPU 推理场景下最高可实现 43% 的性能提升,成为目前边缘端与基于 CPU 部署场景中,速度与精度兼顾的领先目标检测模型之一。

分类、检测、分割、姿态估计、旋转框检测、目标跟踪,全部在一个框架里完成。这意味着你不需要为不同任务维护多套代码,训练、验证、推理、导出一气呵成,大大降低了开发和部署的复杂度。

关键创新:化繁为简,效率飞跃

YOLO26 引入多项核心创新,全面提升推理速度、训练稳定性与部署便捷性。

- 移除分布焦点损失(DFL): 简化边界框预测流程,提升硬件兼容性,让模型更易于在边缘设备与低功耗硬件上部署。

- 端到端无 NMS 推理: 传统检测器依赖非极大值抑制(NMS)过滤重叠预测,增加延迟与部署复杂度。YOLO26 实现原生端到端推理,直接输出最终结果,无需独立后处理步骤,显著降低延迟,简化集成流程。

- 渐进式损失平衡(ProgLoss) + 小目标感知标签分配(STAL): 优化的损失策略增强训练稳定性,提升检测精度,尤其针对小目标识别,对物联网、机器人及航空影像等边缘应用至关重要。

- MuSGD 优化器: 全新混合优化器,融合传统 SGD 与源自大语言模型训练的 Muon 类优化思想,使训练更稳定、收敛更快,尤其适用于大规模复杂训练场景。

- CPU 推理速度提升高达 43%: 深度针对边缘计算优化,让实时视觉系统可直接运行在摄像头、机器人及嵌入式硬件上,满足低延迟、高可靠性需求。

多任务优化,全面升级

YOLO26 还在各视觉任务上进行了专项优化:

- 实例分割: 引入语义分割损失,配合多尺度原型模块,提升掩码质量与一致性。

- 姿态估计: 集成残差对数似然估计(RLE),更准确建模关键点预测不确定性,同时优化解码流程,兼顾精度与实时性。

- 旋转框检测: 新增角度损失函数,优化方向模糊的方形物体检测,减少边界附近的角度突变,实现更稳定的方向估计。

开放词汇分割新突破

基于 YOLO26 架构与训练策略,Ultralytics 同步推出 YOLOE-26 开放词汇分割模型系列。

它复用了现有分割任务框架,同时支持 文本提示、视觉提示与无提示推理,涵盖所有标准 YOLO 尺寸,在精度与实际应用性能上显著优于早期开放词汇模型。

- 文本/视觉提示

- 无提示

在实用性能上比早期模型明显提升,看得出团队在多模态落地方面也在持续加码。

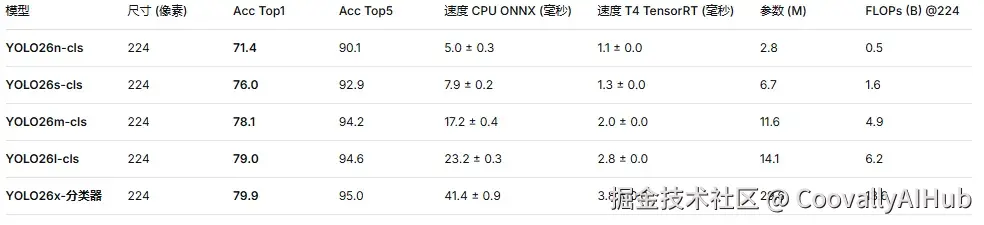

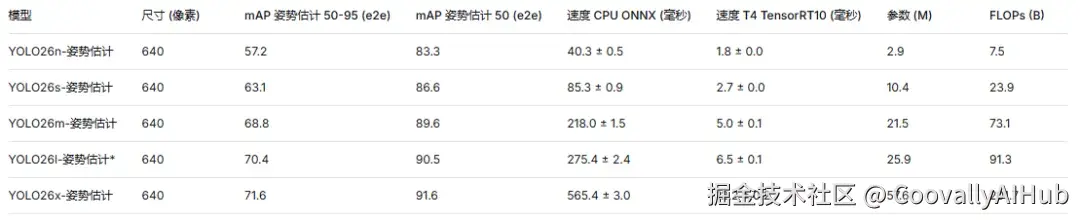

性能数据一览

- 检测(COCO)

- 分割(COCO)

- 分类(COCO)

- 姿势估计(COCO)

- 旋转框检测(COCO)

结语

整体看下来YOLO 26都透露出向"易用、易部署、实际可用"。YOLO26 通过提升性能、简化部署流程并扩展模型功能回应:模型不止要好效果,更要好部署、好维护、好扩展。

不仅是一次技术迭代,更是推动视觉 AI 从"云端演练"走向"边缘实战"的关键一步。未来,随着更多开发者基于 YOLO26 构建实用系统,视觉 AI 将在更多真实场景中落地生根,真正赋能千行百业。同样的Coovally平台也会同步更新YOLO26,让用户第一时间体验最新模型,更多精彩咨询记得持续关注哦~

关注Coovally AI Hub!了解YOLO 26实测效果!

模型下载安装:github.com/ultralytics...

java

from ultralytics import YOLO# Load a pretrained YOLO26 nano modelmodel = YOLO("yolo26n.pt")# Run inference on an imageresults = model("image.jpg")