最近,MCP1(模型上下文协议,Model Context Protocol)在 AI 圈子里火了起来。然而,很多人对它的概念仍然感到困惑,包括我在最初接触时也是如此。

可能有人会问:"这不就是大模型的工具调用吗?"没错,MCP 本质上就是工具调用。但不同的是,过去的工具调用需要开发人员手动编写代码,将工具嵌入应用程序,而 MCP 引入了一种标准化的调用协议。

本文除了通俗易懂的介绍什么是 MCP 协议,并通过几个小问题深入介绍,此外也会讲解如何开发一个自己的 MCP Server。

与传统方式不同,MCP 定义了一套标准化的应用调用协议。Anthropic 官方的比喻是,它就像 AI 界的USB Type-C,让所有支持 MCP 的工具都能即插即用地连接到大模型。这意味着,只要应用程序具备相应的接口,就可以由大模型直接调用,而无需开发者手动适配。

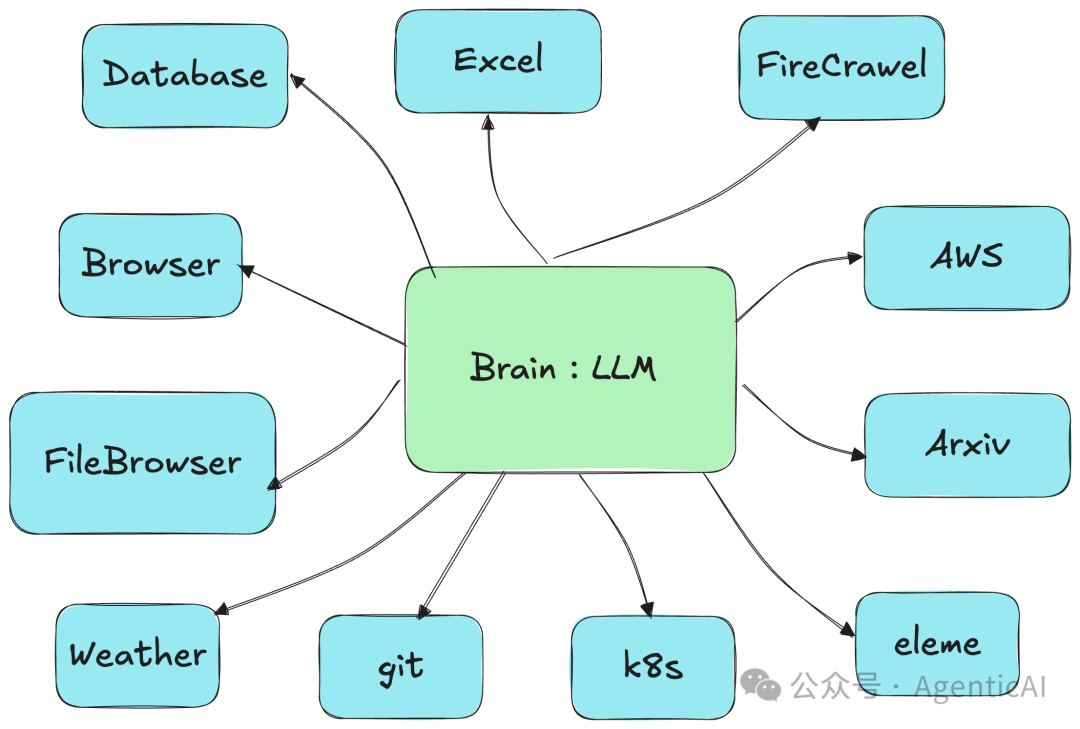

或许之前 Langchain 也发布过 Agent Protocal2, 主要用于智能体之间的互操作协议,相对复杂。而 MCP,由于 cursor、cline 等编程工具的普及,以及多智能体应用 Manus 的火爆,让 MCP 正在成为事实上的标准。它具体是什么呢?上图又是怎么理解呢?

MCP 协议是一个客户端服务器架构。其中大模型作为调用工具方属于客户端,而工具提供方则属于服务器。在此之前,或许我们调用各种各样的官方工具,需要自己写代码。而现在随着 MCP 的普及,作为当前事实上的标准,它将驱动工具提供方主动融入 MCP,自己提供 MCP Server,从而节省开发人员的大量时间。到这,我想你应该大概了解什么是 MCP 了。

1. 只有 Cluade 能用?

首先说结论,不是,大部分的大模型都能使用。MCP 是一个通用协议,支持多种大模型。使用 MCP SDK,我们可以获取可用工具列表,并将其提供给 LLM,比如封装成 OpenAI API 调用的一部分,或者直接作为 Prompt 传递给模型。示例如下:

response = await self.session.list_tools()

available_tools = [{

"name": tool.name,

"description": tool.description,

"input_schema": tool.inputSchema

} for tool in response.tools]

# Initial Claude API call

response = self.anthropic.messages.create(

model="claude-3-5-sonnet-20241022",

max_tokens=1000,

messages=messages,

tools=available_tools

)2. 都有哪些 MCP Server 工具

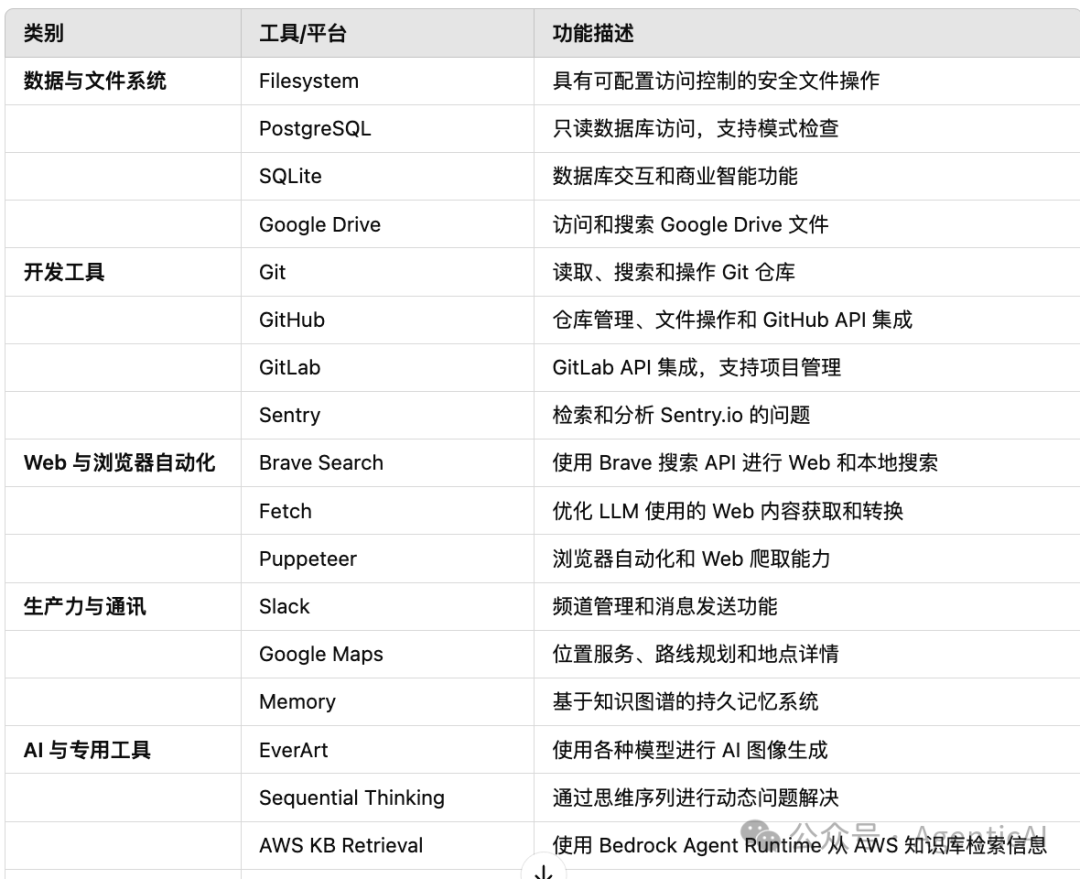

目前,Anthropic 官方已推出了一些常见的 MCP 工具,如数据存储、开发工具、Web 与浏览器访问、Slack 通讯、AI 工具等。

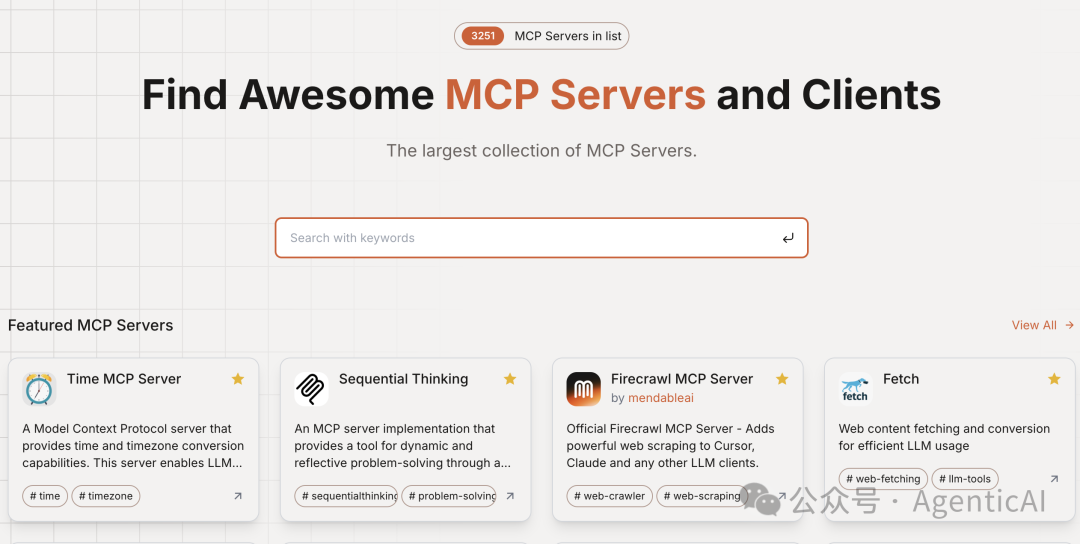

还有一些应用官方开发和社区维护的 MCP Server,比如Obsidian Markdown Notes3、Qdrant4、Cloudflare5、Docker6、Kubernetes7、Todoist8和Spotify9等。这里有个聚合网站10已经收录了 3251 个 MCP server 和 98 个 clients。

3. 怎么开发自己的 MCP Server

这里摘录自官方教程,开发一个提供天气查询的例子。

-

设置开发环境

Create a new directory for our project

uv init weather

cd weatherCreate virtual environment and activate it

uv venv

source .venv/bin/activateInstall dependencies

uv add "mcp[cli]" httpx

Create our server file

touch weather.py

-

初始化

from typing import Any

import httpx

from mcp.server.fastmcp import FastMCPInitialize FastMCP server

mcp = FastMCP("weather")

Constants

NWS_API_BASE = "https://api.weather.gov"

USER_AGENT = "weather-app/1.0" -

编写工具

和编写大模型工具一样,也要编写函数描述,参数描述信息,最终返回字符串供大模型理解。

@mcp.tool()

asyncdef get_alerts(state: str) -> str:

"""Get weather alerts for a US state.

Args:

state: Two-letter US state code (e.g. CA, NY)

"""

url = f"{NWS_API_BASE}/alerts/active/area/{state}"

data = await make_nws_request(url)

ifnot data or"features"notin data:

return"Unable to fetch alerts or no alerts found."

ifnot data["features"]:

return"No active alerts for this state."

alerts = [format_alert(feature) for feature in data["features"]]

return"\n---\n".join(alerts)- 运行

运行后,MCP Server 便可以对外提供服务。在实际应用中,工具服务通常不会一直运行,而是在大模型需要调用时,MCP 客户端会自动启动它。

if __name__ == "__main__":

# Initialize and run the server

mcp.run(transport='stdio')- 客户端

客户端,就是大模型的应用端。他要如何接入这个工具服务呢?首先使用 mcp 客户端初始化一个 mcp 并连接到工具服务器上,然后输入刚才的脚本地址,他就会自动启动上面的天气查询服务。

from mcp import ClientSession, StdioServerParameters

from mcp.client.stdio import stdio_client

...

class MCPClient:

def __init__(self):

# Initialize session and client objects

self.session: Optional[ClientSession] = None

self.exit_stack = AsyncExitStack()

self.anthropic = Anthropic()

# methods will go here

asyncdef connect_to_server(self, server_script_path: str):

"""Connect to an MCP server

Args:

server_script_path: Path to the server script (.py or .js)

"""

...

command = "python"if is_python else"node"

server_params = StdioServerParameters(

command=command,

args=[server_script_path],

env=None

)

stdio_transport = await self.exit_stack.enter_async_context(stdio_client(server_params))

self.stdio, self.write = stdio_transport

self.session = await self.exit_stack.enter_async_context(ClientSession(self.stdio, self.write))

await self.session.initialize()

# List available tools

response = await self.session.list_tools()

tools = response.tools

print("\nConnected to server with tools:", [tool.name for tool in tools])接下来就是调用的逻辑了,就是通过这个协议 sdk,获取工具列表然后塞到大模型就完事了。没有什么黑科技,MCP 做的就是让大模型应用能够自动通过 mcp 这套通信机制调用应用工具。可以看到,本质还是工具调用,只是自动化了外部工具的通信协议。

async def process_query(self, query: str) -> str:

"""Process a query using Claude and available tools"""

messages = [

{

"role": "user",

"content": query

}

]

response = await self.session.list_tools()

available_tools = [{

"name": tool.name,

"description": tool.description,

"input_schema": tool.inputSchema

} for tool in response.tools]

# Initial Claude API call

response = self.anthropic.messages.create(

model="claude-3-5-sonnet-20241022",

max_tokens=1000,

messages=messages,

tools=available_tools

)

# Process response and handle tool calls

final_text = []

assistant_message_content = []

for content in response.content:

if content.type == 'text':

...

elif content.type == 'tool_use':

tool_name = content.name

tool_args = content.input

# Execute tool call

result = await self.session.call_tool(tool_name, tool_args)

final_text.append(f"[Calling tool {tool_name} with args {tool_args}]")

....

return"\n".join(final_text)我想接下来,就没有必要再深入介绍了。

5. 是否只支持 Python

官方除了发布 Python 的 SDK 之外,也支持

-

Typescript-sdk11

-

Java-sdk12

-

kotlin-sdk13

其他语言也可以根据标准specification14自行编写。

6. 底层通信协议

底层通信采用JSON-RPC15,更具体的可以参考官方文档 Transports16。

7. 总结

未来,随着大模型应用的深入,MCP Server 将变得更加丰富和强大,各类应用也将逐步适配 MCP,降低 AI 接入门槛。正如 OpenAI CEO Sam Altman 所说,2025 is "the year of the AI agent"。或许不久的将来,我们只需一句话,就能让 AI 远程操控电脑、管理手机,彻底改变人机交互方式。

如何学习AI大模型?

我在一线互联网企业工作十余年里,指导过不少同行后辈。帮助很多人得到了学习和成长。

我意识到有很多经验和知识值得分享给大家,也可以通过我们的能力和经验解答大家在人工智能学习中的很多困惑,所以在工作繁忙的情况下还是坚持各种整理和分享。但苦于知识传播途径有限,很多互联网行业朋友无法获得正确的资料得到学习提升,故此将并将重要的AI大模型资料包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。

第一阶段: 从大模型系统设计入手,讲解大模型的主要方法;

第二阶段: 在通过大模型提示词工程从Prompts角度入手更好发挥模型的作用;

第三阶段: 大模型平台应用开发借助阿里云PAI平台构建电商领域虚拟试衣系统;

第四阶段: 大模型知识库应用开发以LangChain框架为例,构建物流行业咨询智能问答系统;

第五阶段: 大模型微调开发借助以大健康、新零售、新媒体领域构建适合当前领域大模型;

第六阶段: 以SD多模态大模型为主,搭建了文生图小程序案例;

第七阶段: 以大模型平台应用与开发为主,通过星火大模型,文心大模型等成熟大模型构建大模型行业应用。

👉学会后的收获:👈

• 基于大模型全栈工程实现(前端、后端、产品经理、设计、数据分析等),通过这门课可获得不同能力;

• 能够利用大模型解决相关实际项目需求: 大数据时代,越来越多的企业和机构需要处理海量数据,利用大模型技术可以更好地处理这些数据,提高数据分析和决策的准确性。因此,掌握大模型应用开发技能,可以让程序员更好地应对实际项目需求;

• 基于大模型和企业数据AI应用开发,实现大模型理论、掌握GPU算力、硬件、LangChain开发框架和项目实战技能, 学会Fine-tuning垂直训练大模型(数据准备、数据蒸馏、大模型部署)一站式掌握;

• 能够完成时下热门大模型垂直领域模型训练能力,提高程序员的编码能力: 大模型应用开发需要掌握机器学习算法、深度学习框架等技术,这些技术的掌握可以提高程序员的编码能力和分析能力,让程序员更加熟练地编写高质量的代码。

1.AI大模型学习路线图

2.100套AI大模型商业化落地方案

3.100集大模型视频教程

4.200本大模型PDF书籍

5.LLM面试题合集

6.AI产品经理资源合集

👉获取方式:

😝有需要的小伙伴,可以保存图片到wx扫描二v码免费领取【保证100%免费】🆓